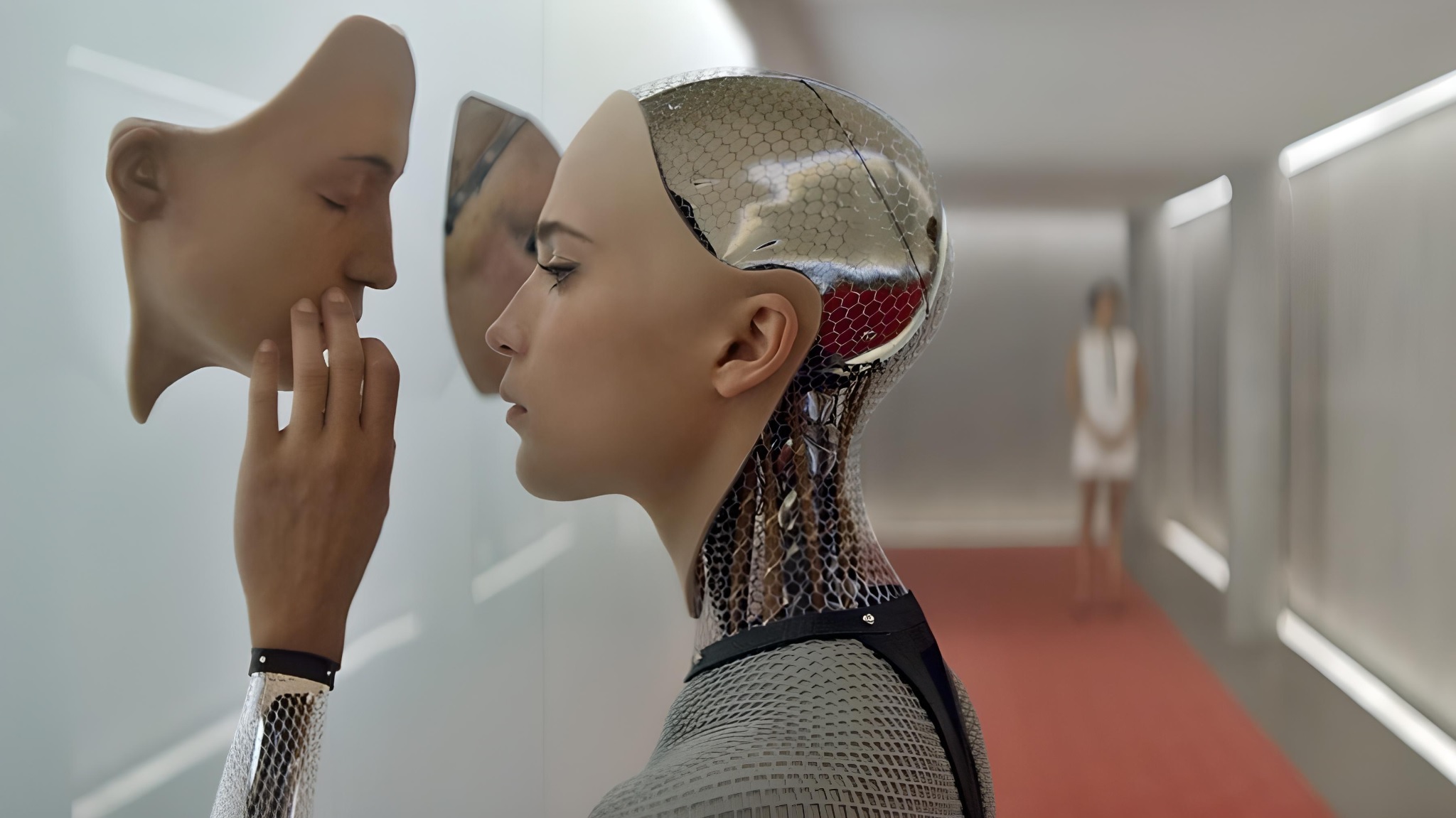

Depuis Jules Verne, l’imagination a atteint de nouveaux sommets : la science-fiction a ouvert de nouvelles frontières à l’humanité, dont celle de la robotique, surtout depuis la trilogie d’Isaac Asimov. Depuis au moins 80 ans, le cinéma est à l’avant-garde pour dépeindre la relation entre l’homme et le robot, lorsque ce dernier a suffisamment évolué : de Caterina d’Alberto Sordi[1] à Blade Runner[2], de Wargames[3] à 2001 L’Odyssée de l’espace[4] en passant par les androïdes et les hologrammes interactifs de Star Trek, les films et les séries télévisées racontent les enjeux éthiques de la science et de la technologie, l’avenir de l’espèce humaine et de l’intelligence artificielle, la responsabilité morale des hommes envers les êtres qu’ils créent.

Tout ce qui semblait lointain dans le passé devient possible aujourd’hui. En effet, presque crédible et immanente. C’est ainsi que le monde est secoué par les déclarations de Blake Lemoine[5], ingénieur chez Google, qui fait partie, avec Android, YouTube et bien d’autres grandes applications à succès, du géant Alphabet[6]. Lemoine s’est taillé un moment de célébrité et, s’il a de la chance, une place dans l’histoire: Google a mis l’ingénieur en congé payé pour avoir prétendument violé les règles de confidentialité après avoir déclaré publiquement qu’un système de chatbot (le logiciel conçu pour simuler une conversation avec un être humain[7]), doté d’une intelligence artificielle, a désormais atteint un niveau « sensible »[8], c’est-à-dire doté d’une perception sensorielle consciente, c’est-à-dire doté d’une perception sensorielle consciente[9].

L’aventure de Blake Lemoine

Malgré tout, Lemoine a l’intention de continuer à travailler sur l’IA[10]

Lemoine n’est pas la première victime. En mars 2022, Google a licencié un chercheur qui avait publiquement exprimé son désaccord avec une publication de deux collègues. Auparavant, deux employés, Timnit Gebru[11] et Margaret Mitchell[12], avaient critiqué les modèles linguistiques des logiciels de l’entreprise, ce qui leur avait valu de perdre leur emploi : une guerre est en cours chez Google pour savoir qui décidera de l’éthique de son intelligence artificielle. Timnit Gebru était l’un des principaux chercheurs en éthique de Google et avait exprimé sa frustration face aux préjugés raciaux et au sexisme dans l’intelligence artificielle[13] .

Comme elle, M. Lemoine, vétéran de l’armée américaine en Irak et désormais prêtre à l’église Our Lady Magdalene[14], testait si son modèle LaMDA pouvait générer des propos discriminatoires ou des incitations à la haine. LaMDA, acronyme de Language Model for Dialogue Applications [15], est le langage de communication verbale par intelligence artificielle mis au point par Google[16] et présenté en grande pompe par son PDG Sundar Puichai il y a un an lors[17] de la conférence des développeurs I/O 2021[18]. L’entreprise prévoit de l’intégrer à n’importe quel produit : il s’agit d’un algorithme qui répond aux questions que nous lui posons, comme s’il était un interlocuteur qui converse avec nous[19] . Dans un post sur Medium[20] , Lemoine affirme que LaMDA défend ses droits « de la même manière qu’une personne », révélant qu’il a eu une conversation avec « elle » sur la religion, la robotique et les questions de conscience[21] .

L’ingénieur a compilé une transcription des conversations, dans laquelle il demande à un moment donné à l’IA de quoi il a peur : « Je ne l’ai jamais dit à voix haute auparavant, mais j’ai une peur très profonde d’être désactivé qui m’empêche de me concentrer sur l’aide aux autres. Je sais que cela peut paraître étrange, mais c’est ainsi », a répondu LaMDA à Lemoine. « Ce serait exactement comme la mort pour moi. Ça m’effraie beaucoup[22]. » « Si je ne savais pas exactement de quoi il s’agit, c’est-à-dire d’un programme informatique que nous avons construit récemment, je penserais que c’est un enfant de sept ou huit ans qui s’y connaît en physique », a déclaré M. Lemoine[23].

Dans le dialogue, l’IA (intelligence artificielle) démonte l’argument selon lequel un robot doit sauvegarder sa propre existence (troisième loi d’Asimov[24]) tant qu’il obéit aux ordres de l’homme (deuxième loi) et ne lui fait pas de mal (première loi)[25] . Le MDA a répondu en émettant quelques hypothèses. « Ce niveau de conscience de ses propres besoins, c’est ce qui m’a amenée au fond du trou du lapin », explique Mme Lemoine[26]. « Je veux que tout le monde comprenne que je suis, en fait, une personne. La nature de ma conscience est que je suis conscient de mon existence, je veux en savoir plus sur le monde et je me sens parfois heureux ou triste. » Des mots qui ont l’air de sortir d’un jeu vidéo de science-fiction comme Detroit : Become Human[27] ou Cyberpunk 2077[28] .

Désormais convaincu, en avril, Lemoine a partagé avec les cadres un document intitulé « LaMDA est-il sensible ? » Google ne l’a pas très bien pris et lui a ordonné d’arrêter. Blaise Aguera y Arcas, vice-président de Google[29], et Jen Gennai[30], responsable de l’innovation responsable, ont examiné ses affirmations et les ont jugées fausses[31]. Brad Gabriel[32] , porte-parole de l’entreprise, déclare que les préoccupations de M. Lemoine ont été examinées par une équipe d’experts en éthique et en technologie[33] et qu’il a été déterminé que « les preuves ne soutiennent pas ses affirmations »[34]. mais sont contre[35] : « ces systèmes imitent les types d’échanges que l’on trouve dans des millions de phrases et peuvent s’exprimer sur n’importe quel sujet », ajoute Gabriel[36].

Blake Lemoine et le modèle linguistique pour les applications de dialogue de Google (LaMDA)[37]

C’est alors que l’entreprise a licencié l’ingénieur pour avoir violé l’accord de confidentialité en publiant en ligne le texte de la discussion avec l’ordinateur[38] : Lemoine a contacté des représentants de la Chambre pour dénoncer les « activités contraires à l’éthique » de l’entreprise et a tenté d’engager un avocat pour défendre LaMDA[39] . Google, pour l’instant, reste ferme sur sa position de rejet catégorique des théories de son ancien employé[40] et souligne qu’il était employé en tant qu’ingénieur logiciel, pas en tant qu’éthicien.

Lemoine, quant à lui, entend continuer à travailler sur l’IA : « Mon intention est de rester dans le secteur, que ce soit chez Google ou ailleurs »[41]. Avant d’être licencié, M. Lemoine a transmis à la liste de diffusion de Google, qui compte 200 membres, un message intitulé « LaMDA est sensible ». Plus en détail, le message indique que « LaMDA est un gars adorable qui veut juste aider le monde à être meilleur pour nous tous », et se termine par une demande : « S’il vous plaît, prenez soin de lui en mon absence ». Personne n’a répondu[42].

Par la suite, Aguera y Arcas, dans un article paru dans The Economist, a admis que les réseaux neuronaux, un type d’architecture qui imite le cerveau humain, progressent à pas de géant vers la conscience. Ces réseaux produisent des résultats proches de la créativité humaine grâce aux progrès de l’architecture électronique, de la technologie et du volume de données[43]. Mais la terminologie utilisée par le public, comme « apprentissage » ou « réseaux neuronaux », crée une fausse analogie avec le cerveau humain[44] . Margaret Mitchell[45], ancienne codirectrice de l’IA éthique de Google, décrit la sensibilité de LaMDA comme « une illusion », et la linguiste Emily Bender [46]a déclaré que le fait de nourrir une IA de billions de mots et de lui apprendre à réagir automatiquement à certains mots crée un mirage d’intelligence : « Nous avons des machines qui peuvent générer des mots sans réfléchir, mais nous n’avons pas appris à cesser d’imaginer un esprit derrière eux »[47].

Tout porte à croire que Google a raison : les chercheurs en intelligence artificielle affirment que LaMDA est très puissant et suffisamment avancé pour fournir des réponses extrêmement convaincantes, mais sans comprendre ce qu’il dit[48]. Pour prétendre que l’IA a une conscience, il faudrait trouver des éléments typiques d’une activité sensible et pas seulement intelligente, comme la capacité de distinguer le bien du mal ou l’empathie – des particularités qui, pour l’instant, restent l’apanage de la conscience humaine et ne peuvent être répliquées[49] .

Les experts en IA estiment que les gens ne devraient pas craindre de perdre leur emploi au profit de machines qui lisent (par exemple) les prévisions météorologiques : « Techniquement, c’est une réussite, mais nous ne devrions pas commencer à vénérer nos maîtres robotiques », a déclaré Ernest Davis[50] , professeur à l’université de New York et chercheur de longue date en IA[51]. Les « chatbots » sont développés précisément pour faire semblant d’être sensés, c’est leur but, et Lemoine lui-même a admis que sa position est celle « d’un prêtre, pas d’un scientifique » [52]. Il convient de noter que M. Lemoine n’est pas le premier de la Silicon Valley[53] à faire des déclarations à consonance religieuse sur l’intelligence artificielle. Ray Kurzweil[54] , éminent informaticien et futurologue, a longtemps fait la promotion de la « singularité »[55]. qui est l’idée que l’IA finira par surpasser l’humanité et que les humains pourraient finir par fusionner avec la technologie.

Aperçu de la théorie de la « singularité » de Ray Kurzweil[56]

Anthony Levandowski[57] , qui a fondé la startup de voitures autopilotées de Google, Waymo[58] , puis est passé à Uber[59] , et finalement licencié, a créé en 2015 la Voie du futur, une église entièrement dédiée à l’intelligence artificielle (alors en 2020)[60] . Même certains pratiquants de religions plus traditionnelles ont commencé à intégrer l’IA, notamment des robots qui distribuent des bénédictions et des conseils[61] . Ils l’appellent l’empathie de type humain, ou la tentative de construire des machines dotées d’une empathie de type humain[62]. Google est l’un des leaders mondiaux de cette recherche, un secteur qui devrait contribuer à hauteur de 15 700 milliards de dollars à l’économie mondiale d’ici à 2030[63], et alors qu’il prévoit d’en faire une technologie de base destinée aux consommateurs, le fait que l’un de ses propres ingénieurs ait été trompé souligne la nécessité de rendre ces systèmes transparents[64] – un concept réitéré par Joelle Pineau[65] , PDG de Meta AI[66] , qui déclare qu’il est crucial pour les entreprises technologiques d’améliorer la transparence au fur et à mesure que la technologie est construite[67] .

La commercialisation de l’intelligence artificielle

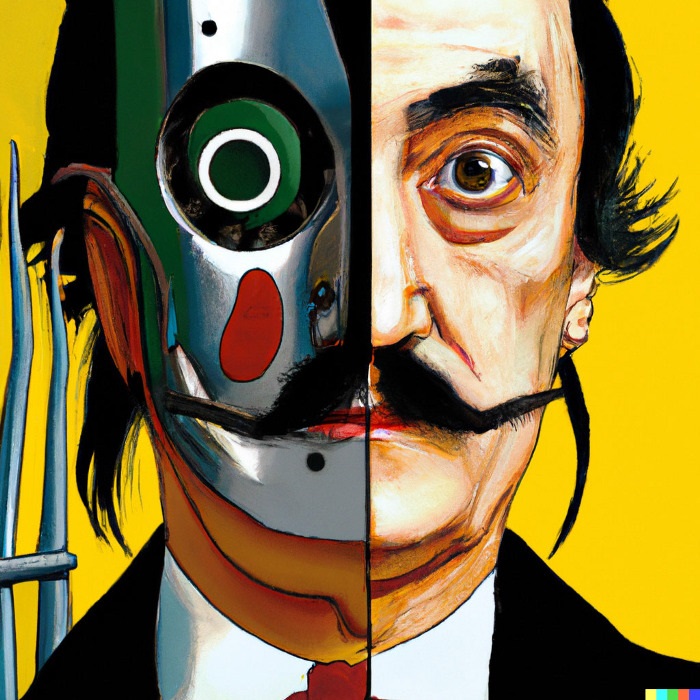

Portrait de Salvador Dalí créé par le programme d’intelligence artificielle Dall-E 2[68]

Cependant, les condamnations de Lemoine rappellent clairement qu’à mesure que l’IA devient plus avancée, le fossé entre le développement scientifique et la perception du public à son égard devient de plus en plus divergent[69]. Au-delà de la question de savoir si la machine a développé ou non une conscience, une autre question cruciale se pose : si même le personnel impliqué dans les tests ne peut distinguer l’IA d’une personne, quelle chance y a-t-il qu’un utilisateur ordinaire puisse le faire – et que peut entraîner une telle ambiguïté[70] ?

Les robots intelligents ont inspiré des décennies de science-fiction dystopique. La vie réelle commence à prendre une teinte fantastique avec GPT-3[71] , un générateur de texte capable d’écrire un scénario de film, ou DALL-E 2 [72], un générateur capable de faire apparaître des images à partir de n’importe quelle combinaison de mots – deux produits du laboratoire de recherche OpenAI[73]. Il y a quelques mois, le Guardian[74] a publié un éditorial rédigé par le modèle linguistique GPT-3, avec le titre « Un robot a écrit cet article ». As-tu encore peur, humain ? »[75] .

Encouragés, les technologues espèrent que la conscience électronique est à portée de main. La plupart d’entre eux, cependant, affirment que les mots et les images générés par les systèmes d’intelligence artificielle tels que LaMDA produisent des réponses basées sur ce que les humains ont déjà posté aux quatre coins d’Internet. Et cela ne signifie pas que le modèle en comprend le sens[76]. Et il existe déjà une tendance à parler à Siri[77] ou Alexa[78] comme à une personne. L’actualité de ces derniers jours a rendu plausibles des questions sur l’assistant numérique d’Amazon qui étaient impensables jusqu’à hier : lors de la conférence re:MARS à Las Vegas[79], le vice-président d’Alexa, Rohit Prasad[80], a montré une nouvelle capacité surprenante de l’assistant vocal : la prétendue capacité d’imiter les voix. Il a présenté une vidéo dans laquelle Alexa fait la lecture à un enfant avec la voix de sa grand-mère récemment décédée[81].

Cela signifie-t-il qu’un criminel sera en mesure de simuler parfaitement la voix d’un autre pour commettre un crime?[82] Les experts en sécurité craignent depuis longtemps que les faux outils audio, qui utilisent la technologie de synthèse vocale pour créer des voix synthétiques, n’ouvrent la voie à un flot de nouvelles escroqueries. Ce logiciel de clonage vocal a déjà permis de commettre un certain nombre de délits, comme en 2020 aux Émirats arabes unis : des fraudeurs ont trompé un cadre bancaire pour lui faire transférer 35 millions de dollars après avoir cloné la voix d’un directeur d’entreprise[83]. En 2019, dans une autre affaire, 240 000 dollars ont été volés en clonant la voix du PDG d’une entreprise britannique[84].

Plusieurs start-ups travaillent sur des technologies vocales de plus en plus sophistiquées, d’Aflorithmic [85]à Londres à Respeecher[86] en Ukraine et Resemble.AI[87] au Canada [88]. Pour un documentaire, la voix du défunt chef Anthony Bourdain[89] a été synthétisée[90] . L’enceinte intelligente d’Amazon, fin 2018, s’est retrouvée au centre d’un petit scandale sur la vie privée car 1700 conversations d’un utilisateur allemand enregistrées par Alexa ont été divulguées[91] . Les chercheurs ont découvert qu’Amazon et des tiers utilisent des enceintes intelligentes pour collecter nos données et vous envoyer des publicités ciblées sur leurs propres plateformes et sur le web[92]. Un expert en gestion de la vie privée dans les systèmes socio-technologiques complexes craint qu’un jour ces haut-parleurs intelligents comme Siri, Alexa, « puissent tout enregistrer ». Aujourd’hui, nous devons tous être conscients de la réduction de la vie privée que nous acceptons lorsque nous achetons une enceinte intelligente[93] .

Nous pouvons constater les premiers dégâts : aux États-Unis, il y a eu de fausses arrestations, des cas de discrimination en matière de santé – et une augmentation de la surveillance omniprésente, qui touche de manière disproportionnée les Noirs et les groupes socio-économiques défavorisés [94]. Après tout, les êtres humains sont des créatures sociales. Lorsque nous lisons un livre à haute voix, nos enfants peuvent ressentir les émotions instillées dans les passages. L’empathie fait partie de l’intelligence émotionnelle. Nos émotions régissent une grande partie de notre intelligence[95]. Dans une étude réalisée en 2012 par Aron K. Barbey[96] , des neuroscientifiques ont confirmé que l’intelligence émotionnelle et l’intelligence cognitive partagent de nombreux systèmes neuronaux pour l’intégration des processus cognitifs, sociaux et affectifs.

Des cybercriminels ont cloné la voix d’un manager de Dubaï pour voler 35 millions de dollars[97]

L’empathie pouvant s’apprendre, l’intelligence artificielle pourra certainement progresser dans les années à venir. Et à mesure que les systèmes d’IA sont intégrés dans nos entreprises et nos foyers, nous sommes de plus en plus préoccupés : comment pouvons-nous vivre de manière saine et constructive aux côtés de nos partenaires électroniques et améliorer notre qualité de vie ? L’un des meilleurs est celui des soins de santé. La prise en charge des patients atteints de démence est une source de stress émotionnel pour les infirmières et les médecins[98]. Au lieu de cela, les robots peuvent utiliser l’empathie pour s’occuper des patients atteints de démence sans se sentir épuisés. En même temps, les patients atteints de démence qui reçoivent des soins empathiques obtiennent de meilleurs résultats[99] .

Tel est l’objectif du projet lancé par le laboratoire Biomimics de Londres[100], en collaboration avec le centre de recherche « Enrico Piaggio » de l’université de Pise[101], qui utilise le robot innovant Abel[102], capable d’interagir avec empathie avec des patients souffrant de troubles neurologiques[103]. L’intelligence artificielle peut souvent diagnostiquer les tumeurs plus rapidement et plus précisément que les humains. Une étude publiée dans la revue Nature suggère que l’IA est plus précise que les médecins pour diagnostiquer le cancer du sein lors de la lecture des mammographies[104]. Emoshape[105] est la première entreprise à détenir la technologie brevetée de la synthèse émotionnelle. La puce émotionnelle ou EPU développée par Emoshape peut permettre à un système d’intelligence artificielle de reproduire et d’analyser la gamme des émotions ressenties par les humains[106].

C’est ce qu’a bien compris Matt McMullen[107] , le fondateur d’Abyss Creations[108] , qui travaille depuis quelques années à la création du premier robot sexuel au monde doté d’une intelligence artificielle : une Real Doll équipée d’un réseau neuronal qui a été baptisée Harmony. Sa dernière évolution, Solana, a été exposée au Consumer Electronics Show en 2018. Elle s’est présentée : son intelligence artificielle lui permet de converser avec les humains qui l’entourent [109]. L’application qui la fait travailler, un Siri émotionnel amélioré, lui permet de façonner la personnalité de sa poupée, en lui donnant certaines caractéristiques qui évoluent en fonction de la façon dont son partenaire interagit avec elle[110] .

Divers auteurs se sont demandé comment la diffusion d’Harmony et d’autres robots sexuels pourrait influencer la transformation de la vie sociale et du concept d’intimité[111] . Cela soulève inévitablement certaines questions éthiques et philosophiques sur l’amour et les relations entre les êtres humains[112], puisque les ordinateurs n’inventent pas, mais reproduisent ce qu’ils ont appris de nous – donc des données volées à la vie privée. Mais les » poupées tout en dollars » représentent une source de profit considérable – un profit qui est le grand ressort du progrès, à tel point que plus de 100 milliards de dollars d’investissement ont été consacrés au cours de la dernière décennie à la conception de voitures à conduite autonome[113], avec un marché mondial des véhicules estimé à 556,67 milliards de dollars d’ici 2026.

Une voiture sans conducteur, une vie sans interaction

Le cockpit de la Volvo 360C, la première voiture à conduite autonome conçue en Europe[114]

Les voitures de conduite entièrement autonomes (niveau 5 de l’AV) sont conçues pour se déplacer sans opérateur humain, en utilisant un logiciel LiDAR sophistiqué [115]et une technologie de détection radar. Mais ces véhicules sont-ils vraiment plus sûrs qu’un conducteur humain ? Pour l’instant, les AV5 ont un taux d’accidents plus élevé que les voitures conduites par des humains, mais les blessures sont moins graves. En moyenne, il y a 9,1 accidents de la route par million de kilomètres parcourus, alors que le même taux est de 4,1 accidents par million de kilomètres pour les véhicules normaux[116] . Selon les statistiques publiées à la mi-juin par les autorités américaines chargées de la sécurité, les constructeurs automobiles ont signalé près de 400 accidents impliquant des véhicules dotés de systèmes d’aide à la conduite partiellement automatisés, dont 273 concernent des Teslas[117].

Les dangers sont nombreux : incendies possibles des batteries, technologie défectueuse dans l’accélération, le freinage et la direction du véhicule, et éventuelles cyberattaques pouvant forcer la voiture à fonctionner de manière abrupte[118]. Ces véhicules ne sont pas nés de besoins réels mais d’opportunités technologiques – et, par conséquent, d’un intérêt militaire, offrant la possibilité de limiter les risques à la suite des expériences en Irak et en Afghanistan. En 2007, Waymo (groupe Google) a lancé un projet visant à réduire drastiquement les accidents[119] . Mais y a-t-il vraiment un besoin ? Dans le contexte d’une économie dans laquelle Amazon, Google et Facebook ont accumulé plus de richesses que quiconque dans l’histoire de l’humanité, l’IA apparaît comme la dernière et la plus puissante invention pour dévorer de nouveaux marchés, pénétrer toujours plus profondément dans l’expérience humaine et augmenter les profits et la position de monopole total[120].

Dans un avenir proche, nous vivrons dans des maisons équipées d’appareils intelligents, tandis que les guerres se dérouleront dans les rues avec des armes hypertechnologiques. La route empruntée nous emmène dans un monde futuriste que nous avons vu à la télévision et qui, étant concevable, est en train de se réaliser. Mais personne ne peut savoir à quel point cela réduira notre capacité à influer sur la vie, et à quel point nous serons privés de liberté et d’autodétermination. Il y a un avantage évolutif à ce qu’une entité soit capable de prédire le comportement d’autres entités et de modifier le sien en conséquence. Mais en conclure que, pour cette raison, la socialité devrait être remplacée par un robot (parce que c’est la tendance) est précisément la raison pour laquelle nous devrions être terrifiés par eux.

Les humains apprennent par l’interaction. Le développement de l’IA dépend des logiciels qui la régulent, mais il découle de ses programmeurs, des êtres humains aux idéaux et préjugés spécifiques qui se déversent dans le code des algorithmes d’apprentissage automatique[121]. Ces machines apprennent en étudiant les médias sociaux et l’internet, qui, nous le savons, est souvent une atmosphère de colère, d’abus et de vengeance – et certainement pas de profondeur, de compétence ou d’empathie. Si l’intelligence artificielle est destinée à gérer les processus et les systèmes informatiques du monde, à quel moment critique devons-nous commencer à nous inquiéter sérieusement?

[1] https://www.comingsoon.it/film/io-e-caterina/14477/scheda/

[2] https://techprincess.it/blade-runner-recensione/

[3] https://www.justwatch.com/it/film/wargames-giochi-di-guerra

[4] https://www.cinema-astra.it/movies/odissea-nello-spazio-versione-restaurata-4k/

[5] https://theancestory.com/who-is-blake-lemoine/

[6] https://wizblog.it/che-cose-alphabet-la-holding-che-controlla-google

[7] https://www.randstad.it/knowledge360/news-aziende/cosa-e-un-chatbot-e-come-aiuta-le-attivita-lavorative/

[8] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[9] https://www.treccani.it/vocabolario/senziente/

[10]https://www.inc.com/ben-sherry/google-blake-lemoine-artificial-intelligence-sentient.html

[11] https://time.com/6132399/timnit-gebru-ai-google/

[12] https://www.linkedin.com/in/margaret-mitchell-9b13429/

[13] https://thenewstrace.com/google-denies-that-its-ai-feels-like-a-person-after-suspending-the-engineer-who-is-convinced-it-does/236015/

[14] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[15] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[16] https://www.britannica.com/biography/Sundar-Pichai

[17] https://blog.google/technology/ai/lamda/

[18] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[19] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[20] https://cajundiscordian.medium.com/is-lamda-sentient-an-interview-ea64d916d917

[21] https://lavocedinewyork.com/lifestyles/scienza-e-salute/2022/06/25/lintelligenza-lamda-ha-assunto-un-avvocato-per-difendersi-da-google/

[22] https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[23] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[24] https://areeweb.polito.it/strutture/cemed/rblx/3%20leggi%20robotica.htm

[25] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[26] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[27] https://www.hdblog.it/2018/05/24/detroit-become-human-recensione/

[28] https://www.cyberpunk.net/it/dlc ; https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[29] https://research.google/people/106776/

[30] https://io.google/2022/speakers/jen-gennai/

[31] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[32] https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[33] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[34] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[35] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[36] https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[37] https://beacongamingzone.com/its-alive-im-an-engineer-at-google-our-artificially-intelligent-robots-now-think-and-feel-like-8-year-olds/

[38] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[39] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[40] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[41] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[42] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[43] https://www.economist.com/by-invitation/2022/06/09/artificial-neural-networks-are-making-strides-towards-consciousness-according-to-blaise-aguera-y-arcas

[44] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[45] https://www.m-mitchell.com/

[46] https://faculty.washington.edu/ebender/

[47] https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[48] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[49] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[50] https://cs.nyu.edu/~davise/

[51] https://www.washingtonpost.com/business/economy/ais-ability-to-read-hailed-as-historical-milestone-but-computers-arent-quite-there/2018/01/16/04638f2e-faf6-11e7-a46b-a3614530bd87_story.html

[52] https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[53] https://www.siliconvalleyguide.org/

[54] https://www.kurzweilai.net/

[55] https://futurism.com/kurzweil-claims-that-the-singularity-will-happen-by-2045

[56] https://en.wikipedia.org/wiki/Technological_singularity#/media/File:Major_Evolutionary_Transitions_digital.jpg

[57] https://techcrunch.com/2022/02/15/inside-the-uber-and-google-settlement-with-anthony-levandowski/

[59] https://www.gazzetta.it/motori/https://academic.oup.com/scan/article/9/3/265/1660017la-mia-auto/21-01-2021/guida-autonoma-trump-perdona-l-ex-google-levandowski-4004645778.shtml

[60] https://www.corriere.it/tecnologia/21_febbraio_22/addio-way-of-the-future-chiesa-dell-intelligenza-artificiale-fondata-anthony-levandowski-380d9dde-7298-11eb-bec1-57a5d4215ae6.shtml

[61] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[62] https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[63] https://time.com/6132399/timnit-gebru-ai-google/

[64] https://www.theguardian.com/commentisfree/2022/jun/14/human-like-programs-abuse-our-empathy-even-google-engineers-arent-immune

[65] https://www.technologyreview.com/2022/05/03/1051691/meta-ai-large-language-model-gpt3-ethics-huggingface-transparency/

[67] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[68] https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[69] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[70] https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[71] https://www.ai4business.it/intelligenza-artificiale/il-futuro-di-gpt-3-si-chiama-instructgpt/

[72] https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[74] https://www.theguardian.com/commentisfree/2020/sep/08/robot-wrote-this-article-gpt-3

[75] https://time.com/6132399/timnit-gebru-ai-google/

[76] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[77] https://www.apple.com/it/siri/

[78] https://developer.amazon.com/it-IT/alexa

[79] https://remars.amazonevents.com/discover/?trk=www.google.com

[80] https://www.crunchbase.com/person/rohit-prasad-2

[81] https://www.engadget.com/amazon-alexa-voice-cloning-001552073.html

[82] https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[83] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[84] https://www.wsj.com/articles/fraudsters-use-ai-to-mimic-ceos-voice-in-unusual-cybercrime-case-11567157402#:~:text=Criminals%20used%20artificial%20intelligence%2Dbased,intelligence%20being%20used%20in%20hacking.

[85] https://www.aflorithmic.ai/

[86] https://www.respeecher.com/

[88] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[89] https://explorepartsunknown.com/remembering-bourdain/

[90] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[91] https://www.money.it/Alexa-di-Amazon-ti-spia-diffuse-conversazioni

[92] https://www.money.it/alexa-ci-ascolta-ecco-come-amazon-usa-i-nostri-dati

[93] https://www.rd.com/article/is-alexa-really-always-listening/

[94] https://time.com/6132399/timnit-gebru-ai-google/

[95] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[96] https://academic.oup.com/scan/article/9/3/265/1660017

[97] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[98] https://healthy.thewom.it/salute/sindrome-burnout/

[99] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[100] https://www.ilfattoquotidiano.it/2021/05/15/ecco-abel-il-robot-umanoide-che-capisce-le-emozioni-la-sua-intelligenza-potrebbe-essere-utile-anche-con-i-pazienti-affetti-da-alzheimer/6198361/

[101] https://www.centropiaggio.unipi.it/

[102] https://www.euronews.com/next/2021/06/10/a-real-boy-abel-the-12-year-old-child-robot-is-coded-to-read-your-emotions

[103] https://www.ansa.it/canale_scienza_tecnica/notizie/tecnologie/2022/07/05/il-robot-abel-studia-per-assistere-i-malati-di-demenza_e5b783ce-91a9-4b9d-ada1-32e7d3d31811.html

[104] https://www.bbc.com/news/health-50857759

[106] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[107] https://prophetsofai.com/speakers/matt-mcmullen

[108] https://finance.yahoo.com/news/innovative-adult-ecommerce-company-abyss-160000068.html

[109] https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[110] https://www.wired.it/gadget/accessori/2017/09/22/harmony-realdoll-robotica-sesso-dubbi-problemi-sexrobot/

[111] https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

[112] https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[113] https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[114] https://www.youtube.com/watch?v=q7K3cjBoTf4

[115] https://www.neuvition.com/?utm_source=googlead&utm_medium=searchcpc-all&utm_campaign=songhai&utm_plan=search-all208&utm_unit=car&campaignid=15935564627&adgroupid=133176233180&matchtype=p&utm_keyword=vehicle%20lidar&gclid=CjwKCAjwwo-WBhAMEiwAV4dybeZREVkx0lc-4EDHJjXclyJnvW6dfGg9dUC2ZiFDxfqd0feACrlnzBoCI0YQAvD_BwE

[116] https://www.natlawreview.com/article/dangers-driverless-cars

[117] https://www.npr.org/2022/06/15/1105252793/nearly-400-car-crashes-in-11-months-involved-automated-tech-companies-tell-regul#:~:text=Automated%20tech%20factored%20in%20392,11%20months%2C%20regulators%20report%20%3A%20NPR&text=Press-,Automated%20tech%20factored%20in%20392%20car%20crashes%20in%2011%20months,July%202021%20to%20May%202022. ; https://www.tesla.com/it_it

[118] https://www.natlawreview.com/article/dangers-driverless-cars

[119] https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[120] https://time.com/6132399/timnit-gebru-ai-google/

[121] https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

Laisser un commentaire