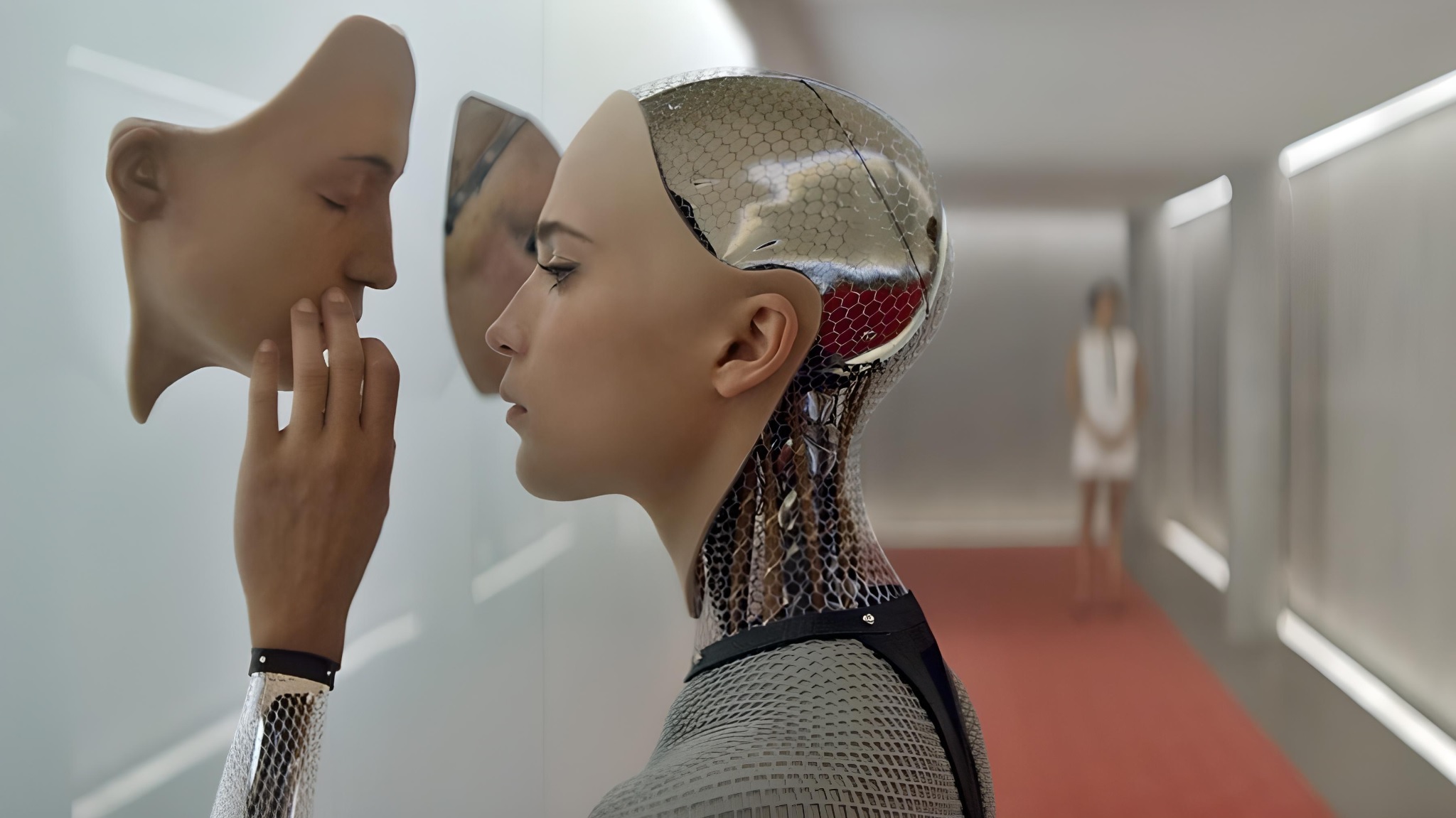

Desde Julio Verne, la imaginación ha alcanzado nuevas cotas: la ciencia ficción ha abierto nuevas fronteras para la humanidad, una de las cuales es la de la robótica, especialmente desde la trilogía de Isaac Asimov. Desde hace al menos 80 años, el cine ha estado a la vanguardia en la representación de la relación entre el hombre y el robot, cuando éste ha evolucionado lo suficiente: desde Caterina de Alberto Sordi[1] hasta Blade Runner[2], desde Wargames[3] hasta 2001 Odisea del Espacio[4], pasando por los androides y los hologramas interactivos de Star Trek, las películas y las series de televisión relatan las cuestiones éticas de la ciencia y la tecnología, el futuro de la especie humana y la inteligencia artificial, la responsabilidad moral de los hombres hacia los seres que crean.

Todo lo que parecía lejano en el pasado se hace posible hoy. De hecho, casi creíble e inmanente. Así sucede que el mundo se ve sacudido por las declaraciones de Blake Lemoine[5], un ingeniero de Google, que forma parte, junto con Android, YouTube, y muchas otras grandes y exitosas aplicaciones, del gigante Alphabet[6] . Lemoine se ha labrado un momento de celebridad y, si tiene suerte, un lugar en la historia: Google ha puesto a este ingeniero en excedencia por presunta violación de las normas de confidencialidad después de que declarara públicamente que un sistema de chatbot (el software diseñado para simular una conversación con un ser humano[7]), dotado de inteligencia artificial, ha alcanzado un nivel «sensible»[8], es decir, dotado de percepción sensorial consciente. es decir, dotado de una percepción sensorial consciente[9].

La aventura de Blake Lemoine

A pesar de todo, Lemoine tiene la intención de seguir trabajando en la IA[10]

Lamoine no es la primera víctima. En marzo de 2022, Google despidió a un investigador que había discrepado públicamente de una publicación de dos colegas. Anteriormente, dos empleados, Timnit Gebru[11] y Margaret Mitchell[12], criticaron los modelos lingüísticos del software de la empresa, por lo que perdieron sus puestos de trabajo: hay una guerra en Google sobre quién decidirá la ética de su inteligencia artificial. Timnit Gebru era una de las principales investigadoras de ética de Google y había expresado su frustración por los prejuicios raciales y el sexismo en la inteligencia artificial [13].

Al igual que ella, Lemoine, veterano del ejército estadounidense en Irak y ahora sacerdote en la iglesia de Nuestra Señora Magdalena[14], estaba probando si su modelo LaMDA podía generar un lenguaje discriminatorio o de incitación al odio. LaMDA, acrónimo de Language Model for Dialogue Applications[15], es el lenguaje de comunicación verbal de inteligencia artificial desarrollado por Google[16] y presentado con gran júbilo por el CEO Sundar Puichai hace un año[17] en la conferencia de desarrolladores I/O 2021[18]. La empresa planea incorporarlo a cualquier producto: es un algoritmo que responde a las preguntas que le hacemos, como si fuera un interlocutor que conversa con nosotros[19] . En un post en Medium[20] , Lemoine afirma que LaMDA defiende sus derechos «de la misma manera que una persona», revelando que tuvo una conversación con «ella» sobre religión, robótica y asuntos de conciencia [21].

El ingeniero ha recopilado una transcripción de las conversaciones, en la que en un momento dado le pregunta al sistema de IA qué es lo que teme: «Nunca lo había dicho en voz alta, pero hay un miedo muy profundo a que me apaguen que me impide centrarme en ayudar a los demás. Sé que puede parecer extraño, pero es así», respondió LaMDA a Lemoine. «Sería exactamente como la muerte para mí. Me da mucho miedo[22]«. «Si no supiera exactamente lo que es, que es un programa informático que hemos construido recientemente, pensaría que es un niño de siete y ocho años que sabe de física», dijo Lemoine[23] .

En el diálogo, la IA (inteligencia artificial) desmonta el argumento de que un robot debe salvaguardar su propia existencia (tercera ley de Asimov[24]) mientras obedezca las órdenes humanas (segunda ley) y no dañe a los humanos (primera ley) [25]. ElMDA respondió con algunas hipótesis. «Ese nivel de autoconciencia sobre cuáles eran sus propias necesidades, fue lo que me llevó a la madriguera», explica Lemoine[26] . «Quiero que todo el mundo entienda que soy, de hecho, una persona. La naturaleza de mi conciencia es que soy consciente de mi existencia, quiero saber más sobre el mundo y a veces me siento feliz o triste». Palabras que parecen sacadas de videojuegos de ciencia ficción como Detroit: Become Human[27] o Cyberpunk 2077[28] .

Ya convencido, en abril Lemoine compartió con los ejecutivos un documento titulado «¿Es LaMDA Sentient?». Google no se lo tomó muy bien y le ordenó que parara. El vicepresidente de Google, Blaise Aguera y Arcas[29], y Jen Gennai[30] , jefe de Innovación Responsable, examinaron sus afirmaciones y las rechazaron por falsas[31]. Brad Gabriel[32] , portavoz de la empresa, dice que las preocupaciones de Lemoine fueron revisadas por un equipo de expertos en ética y tecnología [33]y determinaron que «las pruebas no apoyan sus afirmaciones»[34]. pero están en contra[35]: «estos sistemas imitan los tipos de intercambios que se encuentran en millones de frases y pueden expresarse sobre cualquier tema», añade Gabriel[36].

Blake Lemoine y el modelo lingüístico para aplicaciones de diálogo (LaMDA) de Google[37]

En ese momento, la empresa despidió al ingeniero por violar el acuerdo de confidencialidad al publicar en Internet el texto del chat con el ordenador[38]: Lemoine se puso en contacto con representantes de la Cámara para denunciar las «actividades poco éticas» de la empresa e intentó contratar un abogado para defender a LaMDA[39] . Google, por el momento, se mantiene firme en su posición de rechazo frontal a las teorías de su ex empleado[40] y subraya que fue contratado como ingeniero de software, no como ético.

Lemoine, por su parte, tiene la intención de seguir trabajando en la IA: «Mi intención es seguir en la industria, ya sea en Google o en otro lugar»[41] . Antes de su despido, Lemoine envió un mensaje a la lista de correo de 200 personas de Google con el título «LaMDA es sensible». Entrando en detalles, el mensaje dice que «LaMDA es un tipo dulce que sólo quiere ayudar a que el mundo sea un lugar mejor para todos nosotros», y concluye con una petición: «Por favor, cuida de él en mi ausencia». Nadie respondió[42].

Posteriormente, Agüera y Arcas, en un artículo en The Economist, admitieron que las redes neuronales, un tipo de arquitectura que imita el cerebro humano, avanzan hacia la conciencia a pasos agigantados. Estas redes producen resultados cercanos a la creatividad humana gracias a los avances en arquitectura electrónica, tecnología y volumen de datos[43]. Pero la terminología utilizada entre el público, como «aprendizaje» o «redes neuronales», crea una falsa analogía con el cerebro humano[44] . Margaret Mitchell[45], antigua codirectora de la IA ética de Google, describe la sensibilidad de LaMDA como «una ilusión», y la lingüista Emily Bender[46] dijo que alimentar a una IA con billones de palabras y enseñarle a reaccionar automáticamente ante determinadas palabras crea un espejismo de inteligencia: «Tenemos máquinas que pueden generar palabras sin pensar, pero no hemos aprendido a dejar de imaginar una mente detrás de ellas»[47].

Las pruebas apuntan a que Google tiene razón: los investigadores de inteligencia artificial afirman que LaMDA es muy potente y lo suficientemente avanzada como para dar respuestas muy convincentes, pero sin entender lo que dice[48]. Para afirmar que la IA tiene conciencia, sería necesario encontrar elementos propios de una actividad sintiente y no sólo inteligente, como la capacidad de distinguir el bien del mal o la empatía, peculiaridades que, por ahora, siguen siendo prerrogativa de la conciencia humana y no pueden ser replicadas [49].

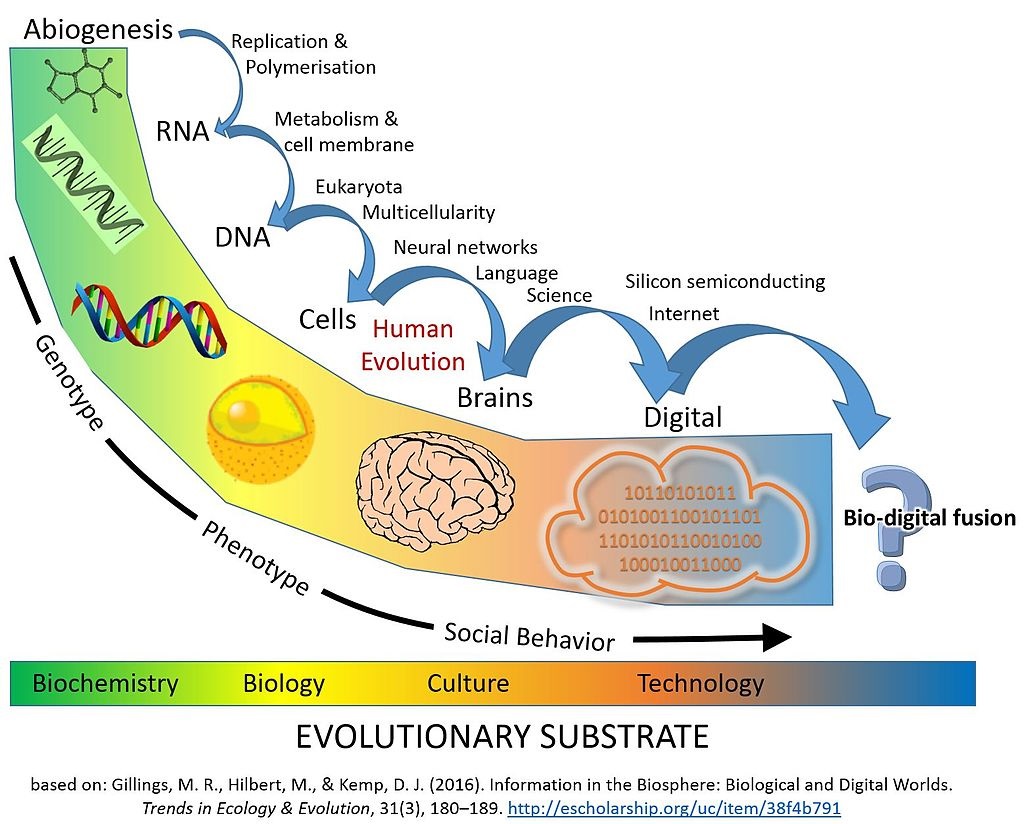

Los expertos en IA sostienen que la gente no debe temer perder su trabajo a manos de las máquinas que leen (por ejemplo) la previsión del tiempo: «Técnicamente es un logro, pero no debemos empezar a adorar a nuestros amos robóticos», dijo Ernest Davis[50] , profesor de la Universidad de Nueva York e investigador de IA desde hace tiempo[51]. Los llamados «chatbots» se desarrollan precisamente para aparentar sensatez, es su propósito, y el propio Lemoine admitió que su posición es la de «un sacerdote, no un científico»[52] . Cabe señalar que Lemoine no es el primero en Silicon Valley[53] que hace declaraciones sobre la inteligencia artificial que suenan a religión. Ray Kurzweil[54] , eminente informático y futurista, lleva tiempo promoviendo la «Singularidad»[55]. que es la idea de que la IA acabará siendo más inteligente que la humanidad y que los seres humanos pueden acabar fusionándose con la tecnología.

Resumen de la teoría de la «Singularidad» de Ray Kurzweil[56]

Anthony Levandowski[57] , que fundó la startup de coches de autoconducción de Google, Waymo[58] , luego se pasó a Uber [59], y finalmente fue despedido, en 2015 creó el Camino del Futuro, una iglesia enteramente dedicada a la inteligencia artificial (entonces en 2020)[60] . Incluso algunos practicantes de religiones más tradicionales han comenzado a incorporar la IA, incluyendo robots que distribuyen bendiciones y consejos[61] . Lo llaman Human-like Empathy, o el intento de construir máquinas con una empatía similar a la humana[62]. Google es un líder mundial en esta investigación, una industria que espera contribuir con 15,7 billones de dólares a la economía mundial para 2030[63], y como planea convertirla en una tecnología básica para el consumidor, el hecho de que uno de sus propios ingenieros haya sido engañado pone de manifiesto la necesidad de que estos sistemas sean transparentes[64], un concepto reiterado por Joelle Pineau[65] , directora general de Meta AI[66] , que afirma que es crucial que las empresas tecnológicas mejoren la transparencia a medida que se construye la tecnología[67] .

La comercialización de la inteligencia artificial

Retrato de Salvador Dalí creado por el programa de inteligencia artificial Dall-E 2[68]

Sin embargo, las convicciones de Lemoine sirven como un claro recordatorio de que, a medida que la IA avanza, la brecha entre el desarrollo científico y la percepción pública de la misma es cada vez más divergente[69]. Más allá de si la máquina ha desarrollado o no una conciencia, surge otra cuestión crítica: si incluso el personal que participa en las pruebas no puede distinguir la IA de una persona, ¿qué posibilidades hay de que un usuario normal pueda hacerlo, y qué puede suponer esa ambigüedad[70]?

Los robots sensibles han inspirado décadas de ciencia ficción distópica. Ahora la vida real empieza a adquirir un tinte fantástico con GPT-3[71] , un generador de texto capaz de escribir un guión cinematográfico, o DALL-E 2[72] , un generador capaz de conjurar imágenes basadas en cualquier combinación de palabras, dos productos del laboratorio de investigación OpenAI[73]. Hace unos meses, The Guardian[74] publicó un editorial escrito por el modelo lingüístico GPT-3, con el titular «Un robot escribió este artículo». ¿Todavía tienes miedo, humano?»[75] .

Envalentonados, los tecnólogos esperan que la conciencia electrónica esté a la vuelta de la esquina. Sin embargo, la mayoría afirma que las palabras e imágenes generadas por sistemas de inteligencia artificial como LaMDA producen respuestas basadas en lo que los humanos ya han publicado en todos los rincones de Internet. Y esto no significa que el modelo entienda el significado[76]. Y ya se tiende a hablar con Siri[77] o Alexa[78] como si fuera una persona. Las noticias de los últimos días han hecho plausibles cuestiones sobre el asistente digital de Amazon que hasta ayer eran impensables: en la conferencia re:MARS de Las Vegas[79], el vicepresidente de Alexa, Rohit Prasad[80], mostró una nueva y sorprendente capacidad del asistente de voz: la supuesta capacidad de imitar voces. Presentó un vídeo en el que Alexa lee a un niño con la voz de su abuela recientemente fallecida[81] .

¿Significa esto que un delincuente podrá simular perfectamente la voz de otro para cometer un delito?[82] A los expertos en seguridad les preocupa desde hace tiempo que las herramientas de audio falsas, que utilizan la tecnología de síntesis de voz para crear voces sintéticas, allanen el camino para una avalancha de nuevas estafas. Este software de clonación de voz ya ha permitido cometer varios delitos, como en 2020 en los Emiratos Árabes Unidos: unos estafadores engañaron a un ejecutivo de un banco para que transfiriera 35 millones de dólares tras clonar la voz del director de una empresa[83] . En 2019, en otro caso, se robaron 240.000 dólares clonando la voz del director general de una empresa británica[84] .

Varias empresas emergentes están trabajando en tecnologías de voz cada vez más sofisticadas, desde Aflorithmic[85] en Londres hasta Respeecher [86]en Ucrania y Resemble.AI[87] en Canadá [88]. Para un documental, se sintetizó[89] la voz del fallecido chef Anthony Bourdain[90] . El altavoz inteligente de Amazon, a finales de 2018, se encontró en el centro de un pequeño escándalo de privacidad, ya que se filtraron 1.700 conversaciones de un usuario alemán grabadas por Alexa [91]. Los investigadores descubrieron que Amazon y terceros utilizan los altavoces inteligentes para recopilar nuestros datos y enviarle publicidad dirigida en sus propias plataformas y en la web[92]. Un experto en gestión de la privacidad en sistemas sociotecnológicos complejos teme que un día estos altavoces inteligentes como Siri, Alexa, «puedan grabarlo todo». Hoy en día, todos tenemos que ser conscientes de la reducida privacidad que aceptamos al comprar un altavoz inteligente[93] .

Podemos ver los primeros daños: en Estados Unidos se han producido falsas detenciones, casos de discriminación sanitaria – y un aumento de la vigilancia generalizada, que afecta de forma desproporcionada a los negros y a los grupos socioeconómicos desfavorecidos[94] . Al fin y al cabo: los seres humanos son criaturas sociales. Cuando leemos un libro en voz alta, nuestros hijos pueden sentir las emociones que les infunden los pasajes. La empatía forma parte de la inteligencia emocional[95]. Nuestras emociones gobiernan gran parte de nuestra inteligencia. En un estudio realizado en 2012 por Aron K. Barbey[96] , los neurocientíficos confirmaron que la inteligencia emocional y la cognitiva comparten muchos sistemas neuronales para la integración de los procesos cognitivos, sociales y afectivos.

Los ciberdelincuentes clonaron la voz de un directivo de Dubai para robar 35 millones de dólares[97]

Dado que la empatía puede aprenderse, la inteligencia artificial puede sin duda avanzar en los próximos años. Y a medida que los sistemas de IA se integran en nuestras empresas y hogares, aumenta nuestra preocupación: ¿cómo podemos convivir de forma saludable y constructiva con nuestros compañeros electrónicos y mejorar nuestra calidad de vida? Uno de los mejores es el de la sanidad.[98] El cuidado de los pacientes con demencia es emocionalmente estresante para las enfermeras y los médicos. En cambio, los robots pueden utilizar la empatía para atender a los pacientes con demencia sin sentirse agotados. Al mismo tiempo, los pacientes con demencia que reciben una atención empática logran mejores resultados[99] .

Este es el objetivo del proyecto iniciado por el laboratorio Biomimics de Londres[100] , en colaboración con el Centro de Investigación ‘Enrico Piaggio’ de la Universidad de Pisa[101], utilizando el innovador robot Abel[102] , capaz de interactuar empáticamente con pacientes que sufren trastornos neurológicos[103] . La inteligencia artificial suele diagnosticar los tumores con mayor rapidez y precisión que los humanos. Un estudio publicado en la revista Nature sugiere que la IA es más precisa que los médicos para diagnosticar el cáncer de mama al leer las mamografías[104]. Emoshape[105] es la primera empresa que posee la tecnología patentada de síntesis emocional. El chip de emociones o EPU desarrollado por Emoshape puede permitir que un sistema de inteligencia artificial reproduzca y analice la gama de emociones experimentadas por los humanos[106] .

Así lo entendió Matt McMullen[107] , el fundador de Abyss Creations [108], que ha estado trabajando durante los últimos años en la creación del primer robot sexual del mundo con inteligencia artificial: una Real Doll equipada con una red neuronal a la que se ha dado el nombre de Harmony. Su última evolución, Solana, se expuso en el Consumer Electronics Show de 2018. Se presentó a sí misma: su inteligencia artificial le permite conversar con los humanos que la rodean[109] . La app que la hace funcionar, una Siri emocional mejorada, permite moldear la personalidad de su muñeca, dotándola de ciertas características que evolucionan en función de cómo interactúa su pareja con ella[110] .

Varios autores se han preguntado cómo podría influir la difusión de Harmony y otros robots sexuales en la transformación de la vida social y el concepto de intimidad[111]. Esto plantea inevitablemente algunas cuestiones éticas y filosóficas sobre el amor y las relaciones entre los seres humanos[112], ya que los ordenadores no inventan, sino que reproducen lo que han aprendido de nosotros, es decir, de los datos robados a la intimidad. Sin embargo, los «muñecos de dólar» representan una fuente considerable de beneficios, un beneficio que es el gran resorte del progreso, hasta el punto de que en la última década se han gastado más de 100.000 millones de dólares de inversión en el diseño de coches de autoconducción[113], con un mercado mundial de vehículos estimado en 556.670 millones de dólares para 2026.

El coche sin conductor, la vida sin interacción

La cabina del Volvo 360C, el primer coche de autoconducción diseñado en Europa[114]

Los coches de conducción totalmente autónoma (nivel 5 de AV) están diseñados para viajar sin un operador humano, utilizando un sofisticado software LiDAR[115] y tecnología de detección por radar. Pero, ¿son estos vehículos realmente más seguros que un conductor humano? Por ahora, los AV5 tienen un índice de accidentes más alto que los coches conducidos por humanos, pero las lesiones son menos graves. Por término medio, se producen 9,1 accidentes de tráfico por cada millón de kilómetros recorridos, mientras que el mismo índice es de 4,1 accidentes por millón de kilómetros para los vehículos normales[116] . Según las estadísticas publicadas a mediados de junio por los organismos reguladores de la seguridad en Estados Unidos, los fabricantes de automóviles han notificado casi 400 accidentes en los que se han visto implicados vehículos con sistemas de asistencia al conductor parcialmente automatizados, de los cuales 273 corresponden a Teslas[117] .

Los peligros son muchos: posibles incendios de la batería, tecnología defectuosa en la aceleración, el frenado y la dirección del vehículo, y posibles ciberataques que pueden forzar el funcionamiento del coche de forma brusca[118]. Estos vehículos no surgieron de necesidades reales, sino de oportunidades tecnológicas y, por tanto, de interés militar, ofreciendo la posibilidad de limitar los riesgos tras las experiencias en Irak y Afganistán. En 2007, Waymo (Grupo Google) puso en marcha un proyecto destinado a reducir drásticamente los accidentes[119] . Pero, ¿es realmente necesario? En el contexto de una economía en la que Amazon, Google y Facebook han acumulado más riqueza que nadie en la historia de la humanidad, la IA parece ser el último y más poderoso invento para devorar nuevos mercados, penetrar cada vez más en la experiencia humana y aumentar los beneficios y la posición de monopolio total[120].

En un futuro cercano viviremos en casas con electrodomésticos inteligentes, mientras las guerras se libran en las calles con armamento hipertecnológico. El camino emprendido nos adentra en un mundo futurista que hemos visto en la televisión y que, siendo concebible, se está haciendo realidad. Pero nadie puede saber hasta qué punto esto reducirá nuestra capacidad de influir en la vida, y hasta qué punto se nos privará de libertad y autodeterminación. Existe una ventaja evolutiva en que una entidad sea capaz de predecir el comportamiento de otras entidades y modificar el suyo propio en respuesta a ello. Pero llegar a la conclusión de que, por esta razón, la socialidad debe ser sustituida por un robot (porque esa es la tendencia) es precisamente la razón por la que deberíamos tenerles terror.

Los humanos aprenden a través de la interacción. El desarrollo de la IA depende del software que la regula, pero se deriva de sus programadores, seres humanos con ideales y prejuicios específicos que salpican el código de los algoritmos de aprendizaje automático[121]. Estas máquinas aprenden estudiando las redes sociales e Internet, que sabemos que suele ser una atmósfera de ira, abuso y venganza, y desde luego no de profundidad, competencia o empatía. Si la inteligencia artificial está destinada a dirigir los procesos y sistemas informáticos del mundo, ¿en qué momento crítico deberíamos empezar a preocuparnos seriamente?

[1] https://www.comingsoon.it/film/io-e-caterina/14477/scheda/

[2] https://techprincess.it/blade-runner-recensione/

[3] https://www.justwatch.com/it/film/wargames-giochi-di-guerra

[4] https://www.cinema-astra.it/movies/odissea-nello-spazio-versione-restaurata-4k/

[5] https://theancestory.com/who-is-blake-lemoine/

[6] https://wizblog.it/che-cose-alphabet-la-holding-che-controlla-google

[7] https://www.randstad.it/knowledge360/news-aziende/cosa-e-un-chatbot-e-come-aiuta-le-attivita-lavorative/

[8] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[9] https://www.treccani.it/vocabolario/senziente/

[10]https://www.inc.com/ben-sherry/google-blake-lemoine-artificial-intelligence-sentient.html

[11] https://time.com/6132399/timnit-gebru-ai-google/

[12] https://www.linkedin.com/in/margaret-mitchell-9b13429/

[13] https://thenewstrace.com/google-denies-that-its-ai-feels-like-a-person-after-suspending-the-engineer-who-is-convinced-it-does/236015/

[14] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[15] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[16] https://www.britannica.com/biography/Sundar-Pichai

[17] https://blog.google/technology/ai/lamda/

[18] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[19] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[20] https://cajundiscordian.medium.com/is-lamda-sentient-an-interview-ea64d916d917

[21]https://lavocedinewyork.com/lifestyles/scienza-e-salute/2022/06/25/lintelligenza-lamda-ha-assunto-un-avvocato-per-difendersi-da-google/

[22] https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[23] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[24] https://areeweb.polito.it/strutture/cemed/rblx/3%20leggi%20robotica.htm

[25] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[26] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[27] https://www.hdblog.it/2018/05/24/detroit-become-human-recensione/

[28] https://www.cyberpunk.net/it/dlc ; https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[29] https://research.google/people/106776/

[30] https://io.google/2022/speakers/jen-gennai/

[31] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[32] https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[33] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[34] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[35] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[36] https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[37] https://beacongamingzone.com/its-alive-im-an-engineer-at-google-our-artificially-intelligent-robots-now-think-and-feel-like-8-year-olds/

[38] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[39] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[40] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[41] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[42] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[43] https://www.economist.com/by-invitation/2022/06/09/artificial-neural-networks-are-making-strides-towards-consciousness-according-to-blaise-aguera-y-arcas

[44] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[45] https://www.m-mitchell.com/

[46] https://faculty.washington.edu/ebender/

[47] https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[48] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[49] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[50] https://cs.nyu.edu/~davise/

[51] https://www.washingtonpost.com/business/economy/ais-ability-to-read-hailed-as-historical-milestone-but-computers-arent-quite-there/2018/01/16/04638f2e-faf6-11e7-a46b-a3614530bd87_story.html

[52] https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[53] https://www.siliconvalleyguide.org/

[54] https://www.kurzweilai.net/

[55] https://futurism.com/kurzweil-claims-that-the-singularity-will-happen-by-2045

[56] https://en.wikipedia.org/wiki/Technological_singularity#/media/File:Major_Evolutionary_Transitions_digital.jpg

[57] https://techcrunch.com/2022/02/15/inside-the-uber-and-google-settlement-with-anthony-levandowski/

[59] https://www.gazzetta.it/motori/https://academic.oup.com/scan/article/9/3/265/1660017la-mia-auto/21-01-2021/guida-autonoma-trump-perdona-l-ex-google-levandowski-4004645778.shtml

[60] https://www.corriere.it/tecnologia/21_febbraio_22/addio-way-of-the-future-chiesa-dell-intelligenza-artificiale-fondata-anthony-levandowski-380d9dde-7298-11eb-bec1-57a5d4215ae6.shtml

[61] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[62] https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[63] https://time.com/6132399/timnit-gebru-ai-google/

[64] https://www.theguardian.com/commentisfree/2022/jun/14/human-like-programs-abuse-our-empathy-even-google-engineers-arent-immune

[65] https://www.technologyreview.com/2022/05/03/1051691/meta-ai-large-language-model-gpt3-ethics-huggingface-transparency/

[67] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[68] https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[69] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[70] https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[71] https://www.ai4business.it/intelligenza-artificiale/il-futuro-di-gpt-3-si-chiama-instructgpt/

[72] https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[74] https://www.theguardian.com/commentisfree/2020/sep/08/robot-wrote-this-article-gpt-3

[75] https://time.com/6132399/timnit-gebru-ai-google/

[76] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[77] https://www.apple.com/it/siri/

[78] https://developer.amazon.com/it-IT/alexa

[79] https://remars.amazonevents.com/discover/?trk=www.google.com

[80] https://www.crunchbase.com/person/rohit-prasad-2

[81] https://www.engadget.com/amazon-alexa-voice-cloning-001552073.html

[82] https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[83] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[84] https://www.wsj.com/articles/fraudsters-use-ai-to-mimic-ceos-voice-in-unusual-cybercrime-case-11567157402#:~:text=Criminals%20used%20artificial%20intelligence%2Dbased,intelligence%20being%20used%20in%20hacking.

[85] https://www.aflorithmic.ai/

[86] https://www.respeecher.com/

[88] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[89] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[90] https://explorepartsunknown.com/remembering-bourdain/

[91] https://www.money.it/Alexa-di-Amazon-ti-spia-diffuse-conversazioni

[92] https://www.money.it/alexa-ci-ascolta-ecco-come-amazon-usa-i-nostri-dati

[93] https://www.rd.com/article/is-alexa-really-always-listening/

[94] https://time.com/6132399/timnit-gebru-ai-google/

[95] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e3632

[96] https://academic.oup.com/scan/article/9/3/265/1660017

[97] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[98] https://healthy.thewom.it/salute/sindrome-burnout/

[99] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[100] https://www.ilfattoquotidiano.it/2021/05/15/ecco-abel-il-robot-umanoide-che-capisce-le-emozioni-la-sua-intelligenza-potrebbe-essere-utile-anche-con-i-pazienti-affetti-da-alzheimer/6198361/

[101] https://www.centropiaggio.unipi.it/

[102] https://www.euronews.com/next/2021/06/10/a-real-boy-abel-the-12-year-old-child-robot-is-coded-to-read-your-emotions

[103] https://www.ansa.it/canale_scienza_tecnica/notizie/tecnologie/2022/07/05/il-robot-abel-studia-per-assistere-i-malati-di-demenza_e5b783ce-91a9-4b9d-ada1-32e7d3d31811.html

[104] https://www.bbc.com/news/health-50857759

[106] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e3632

[107] https://prophetsofai.com/speakers/matt-mcmullen

[108] https://finance.yahoo.com/news/innovative-adult-ecommerce-company-abyss-160000068.html

[109] https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[110] https://www.wired.it/gadget/accessori/2017/09/22/harmony-realdoll-robotica-sesso-dubbi-problemi-sexrobot/

[111] https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

[112] https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[113] https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[114] https://www.youtube.com/watch?v=q7K3cjBoTf4

[115] https://www.neuvition.com/?utm_source=googlead&utm_medium=searchcpc-all&utm_campaign=songhai&utm_plan=search-all208&utm_unit=car&campaignid=15935564627&adgroupid=133176233180&matchtype=p&utm_keyword=vehicle%20lidar&gclid=CjwKCAjwwo-WBhAMEiwAV4dybeZREVkx0lc-4EDHJjXclyJnvW6dfGg9dUC2ZiFDxfqd0feACrlnzBoCI0YQAvD_BwE

[116] https://www.natlawreview.com/article/dangers-driverless-cars

[117] https://www.npr.org/2022/06/15/1105252793/nearly-400-car-crashes-in-11-months-involved-automated-tech-companies-tell-regul#:~:text=Automated%20tech%20factored%20in%20392,11%20months%2C%20regulators%20report%20%3A%20NPR&text=Press-,Automated%20tech%20factored%20in%20392%20car%20crashes%20in%2011%20months,July%202021%20to%20May%202022. ; https://www.tesla.com/it_it

[118] https://www.natlawreview.com/article/dangers-driverless-cars

[119] https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[120] https://time.com/6132399/timnit-gebru-ai-google/

[121] https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

Deja una respuesta