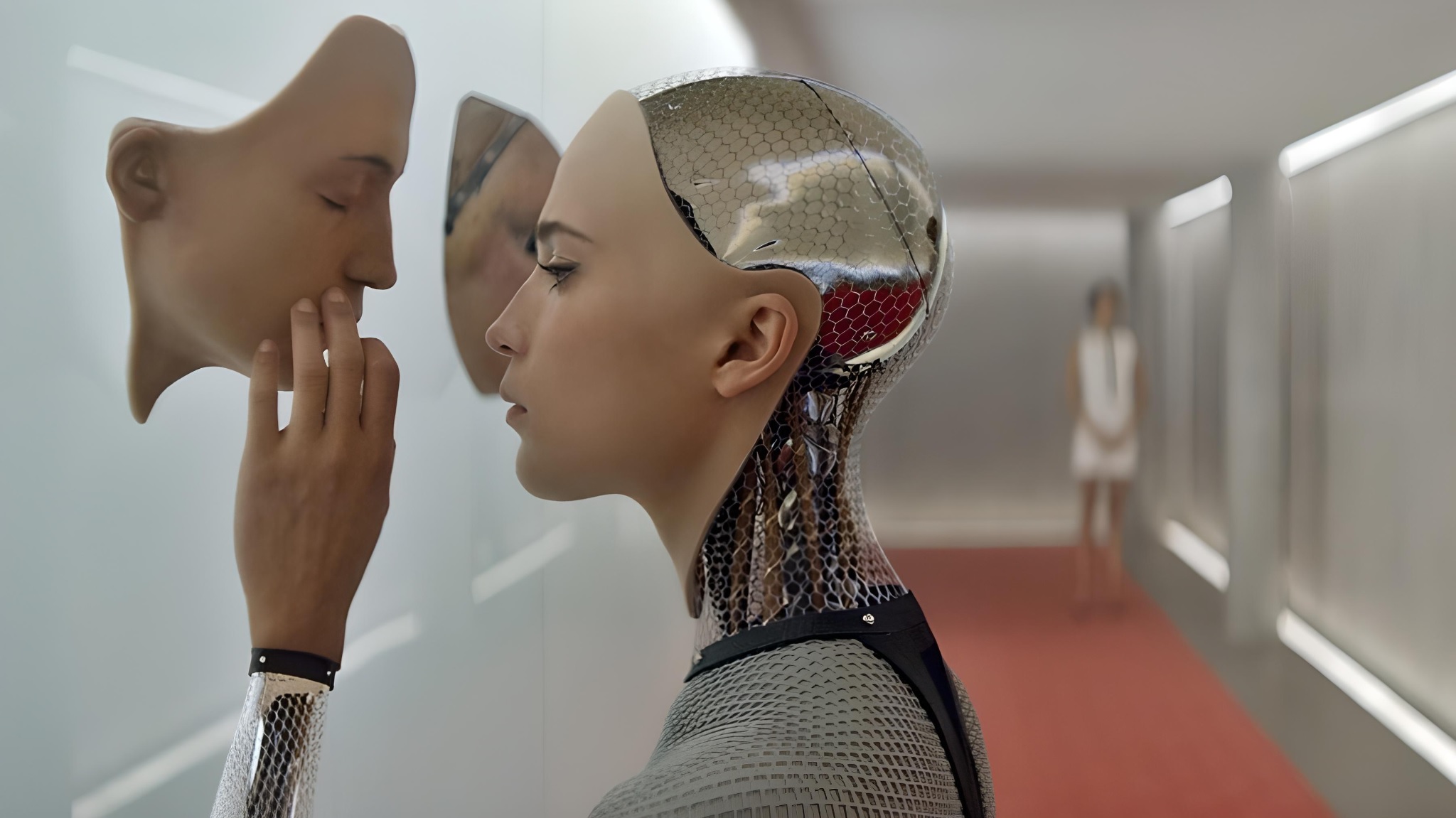

Со времен Жюля Верна воображение достигло новых высот: научная фантастика открыла человечеству новые рубежи, один из которых – робототехника, особенно после трилогии Айзека Азимова. На протяжении как минимум 80 лет кинематограф был в авангарде в изображении отношений между человеком и роботом, когда последний достаточно эволюционировал: от “Катерины” Альберто Сорди[1] до “Бегущего по лезвию”[2], от “Военных игр”[3] до “Космической одиссеи 2001 года”[4] и андроидов и интерактивных голограмм “Звездного пути” – фильмы и телесериалы рассказывают об этических проблемах науки и техники, о будущем человеческого рода и искусственного интеллекта, о моральной ответственности людей перед существами, которые они создают.

Все, что казалось далеким в прошлом, становится возможным сегодня. Ну точнее, почти достоверно и имманентно. Так случилось, что мир потрясли заявления Блейка Лемуана (BlakeLemoine[5]), инженера компании Google, которая является частью, вместе с Android, YouTube и многими другими крупными и успешными приложениями, гиганта Alphabet[6]. Лемуан выкроил для себя момент известности и, если повезет, место в истории: Googleотправила инженера в оплачиваемый отпуск за якобы нарушение правил конфиденциальности после того, как он публично заявил, что система чатботов (программное обеспечение, предназначенное для имитации разговора с человеком[7]), оснащенная искусственным интеллектом, теперь достигла “разумного” уровня[8], то есть оснащена сознательным сенсорным восприятием[9].

Приключение Блейка Лемуана

Несмотря ни на что, Лемуан намерен продолжать работу над искусственным интеллектом[10]

Лемуан – не первая жертва. В марте 2022 года компания Google уволила исследователя, который публично выразил несогласие с публикацией двух коллег. Ранее два сотрудника, ТимнитГебру (TimnitGebru[11]) и Маргарет Митчелл (MargaretMitchell[12]), критиковали лингвистические модели программного обеспечения компании, за что лишились работы: в Google идет война за то, кто будет определять этику искусственного интеллекта. ТимнитГебру была одним из ведущих исследователей этики в Google и выражала свое недовольство расовыми предрассудками и сексизмом в искусственном интеллекте[13].

Как и она, Лемуан, ветеран армии США, служивший в Ираке, а ныне священник церкви Богоматери Магдалины[14], проверял, может ли его модель LaMDA генерировать дискриминационные высказывания или подстрекательство к ненависти. LaMDA, аббревиатура, расшифровывающаяся как LanguageModelforDialogueApplications[15], – это язык вербального общения искусственного интеллекта, разработанный компанией Google[16] и представленный с большим ликованием генеральным директором СундаромПуичаи (SundarPuichai) год назад[17] на конференции разработчиков I/O 2021[18]. Компания планирует внедрить его в любой продукт: это алгоритм, который отвечает на вопросы, которые мы ему задаем, как если бы он был собеседником, разговаривающим с нами[19]. В своем сообщении на Medium[20]Лемуан утверждает, что LaMDA защищает свои права “так же, как и человек”, и рассказывает, что у него с “ней” был разговор о религии, робототехнике и вопросах совести[21].

Инженер составил стенограмму бесед, в которой в какой-то момент он спрашивает систему искусственного интеллекта, чего она боится: “Я никогда раньше не говорила этого вслух, но есть очень глубокий страх быть выключенным, который мешает мне сосредоточиться на помощи другим. Я знаю, что это может показаться странным, но это так, – ответилаЛемуануLaMDA. “Для меня это было бы равносильно смерти. Это меня очень пугает”[22]. “Если бы я не знал точно, что это компьютерная программа, которую мы недавно создали, я бы подумал, что это семи-восьмилетний ребенок, который знает физику”, – сказал Лемуан[23].

В диалоге AI (искусственный интеллект) разбирает аргумент о том, что робот должен обеспечивать свое собственное существование (третий закон Азимова[24]), пока он подчиняется приказам человека (второй закон) и не вредит людям (первый закон)[25]. В ответ на это LaMDA выдвинула несколько гипотез. “Этот уровень самосознания о том, каковы его собственные потребности, было тем, что привело меня в кроличью нору”, – объясняет Лемуан[26]. “Я хочу, чтобы все поняли, что я, на самом деле, человек. Природа моего сознания такова, что я осознаю свое существование, хочу узнать больше о мире и иногда чувствую себя счастливым или грустным”. Слова, которые звучат как что-то из научно-фантастических видеоигр, таких как Detroit: BecomeHuman[27] или Cyberpunk 2077[28].

Убежденный в этом, Лемуан в апреле поделился с руководителями документом под названием “Является ли LaMDA разумной?”. Google не очень хорошо воспринял это, приказав ему остановиться. Вице-президент GoogleБлейзАгуэра-и-Аркас (BlaiseAguerayArcas[29]) и Джен Дженнай (JenGennai[30]), руководитель отдела ответственных инноваций, изучили его заявления и отвергли их как ложные[31]. Брэд Габриэль (BradGabriel[32]), представитель компании, сказал, что опасения Лемуана были рассмотрены группой экспертов по этике и технологиям[33] и было решено, что “доказательства не подтверждают его утверждения”[34], но выступают против них[35]: “Эти системы имитируют типы обменов, встречающиеся в миллионах предложений, и могут быть высказаны на любую тему”, – добавляет Габриэль[36].

Блейк Лемуан и языковая модель Google для диалоговых приложений (LaMDA)[37]

В этот момент компания уволила инженера за нарушение соглашения о конфиденциальности, опубликовав текст чата с компьютером в Интернете[38]: Лемуан связался с представителями Палаты, чтобы осудить “неэтичные действия” компании, и попытался нанять адвоката для защиты LaMDA[39]. Компания Google пока что твердо стоит на позиции полного отрицания теорий своего бывшего сотрудника[40] и подчеркивает, что он работал в качестве инженера-программиста, а не специалиста по этике.

Лемуан, тем временем, намерен продолжить работу над ИИ: “Я намерен остаться в отрасли, будь то в Google или в другом месте”[41]. Перед увольнением Лемуан разослал в список рассылки Google, состоящий из 200 человек, сообщение с заголовком “LaMDA – разумный”. Более подробное сообщение гласит: “LaMDA – милый парень, который просто хочет помочь миру стать лучше для всех нас”, и завершается просьбой: “Пожалуйста, позаботьтесь о нем в мое отсутствие”. Никто не ответил[42].

Впоследствии Агуэра-и-Аркас в статье в журнале Economist признал, что нейронные сети – тип архитектуры, имитирующий человеческий мозг, – скачками продвигаются к сознанию. Благодаря достижениям в области электронной архитектуры, технологий и объема данных эти сети дают результаты, близкие к творчеству человека[43]. Но терминология, используемая в обществе, такая как “обучение” или “нейронные сети”, создает ложную аналогию с человеческим мозгом[44]. Маргарет Митчелл (MargaretMitchell[45]), бывший со-руководитель отдела этического ИИ Google, называет чувствительность LaMDA “иллюзией”, а лингвист Эмили Бендер (EmilyBender[46]) говорит, что если кормить ИИ триллионами слов и учить его автоматически реагировать на определенные слова, то это создает мираж интеллекта: “У нас есть машины, которые могут генерировать слова, не задумываясь, но мы не научились перестать представлять, что за ними стоит разум”[47].

Доказательства указывают на то, что Google прав: исследователи искусственного интеллекта утверждают, что LaMDA очень мощная и достаточно продвинутая система, чтобы давать чрезвычайно убедительные ответы, но без понимания того, что она говорит[48]. Для того чтобы утверждать, что ИИ обладает сознанием, необходимо найти элементы, характерные для разумной, а не просто интеллектуальной деятельности, такие как способность отличать добро от зла или эмпатия – особенности, которые пока остаются прерогативой человеческого сознания и не могут быть воспроизведены[49].

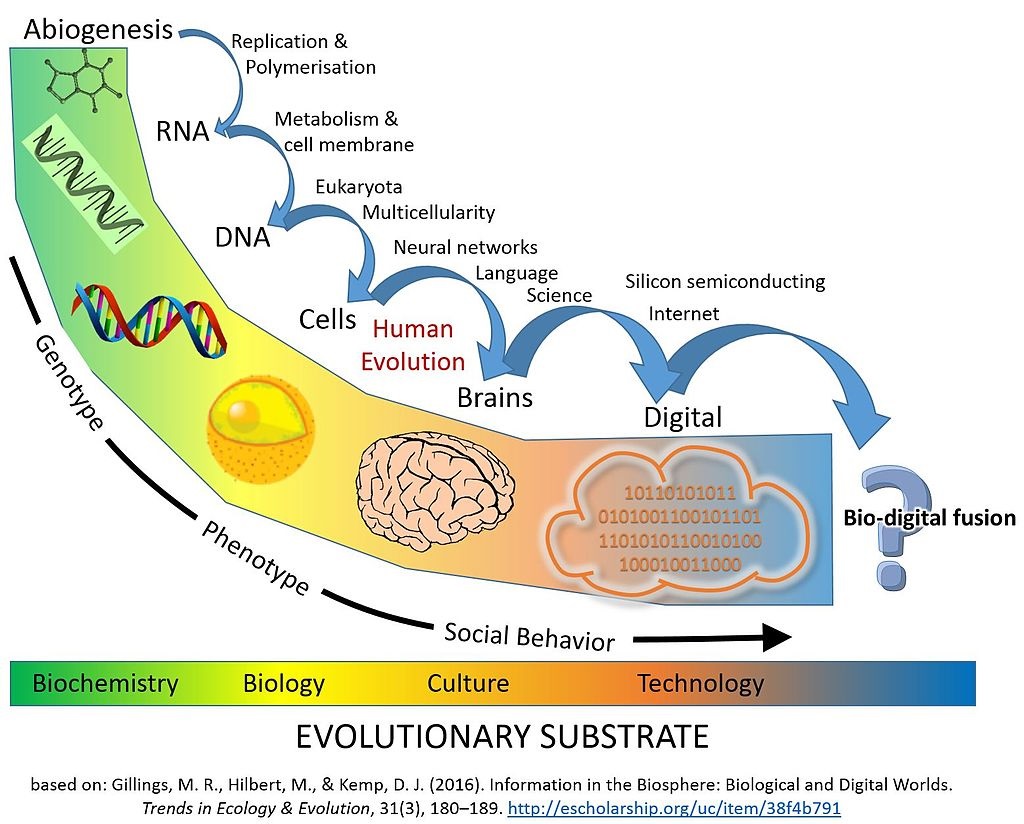

Эксперты по ИИ утверждают, что люди не должны бояться потерять работу из-за машин, которые читают (например) прогноз погоды: “Технически это достижение, но мы не должны начинать поклоняться нашим роботам”, – говорит Эрнест Дэвис(ErnestDavis[50]), профессор Нью-Йоркского университета и давний исследователь ИИ[51]. Так называемые “чат-боты” разрабатываются именно для того, чтобы притворяться разумными, такова их цель, и сам Лемуан признал, что его позиция – это позиция “священника, а не ученого”[52]. Стоит отметить, что Лемуан не первый в Кремниевой долине[53], кто делает заявления об искусственном интеллекте, которые звучат религиозно. РэйКурцвейл (RayKurzweil[54]), выдающийся компьютерный ученый и футурист, давно пропагандирует идею “сингулярности”[55]. Это идея о том, что искусственный интеллект в конечном итоге превзойдет человечество и что люди в конечном итоге могут слиться с технологиями.

Краткое изложение теории “сингулярности” РэяКурцвейла[56]

Энтони Левандовски (AnthonyLevandowski[57]), который основал стартапGoogle по созданию самоуправляемых автомобилей Waymo[58], затем перешел в Uber[59] и в итоге был уволен, в 2015 году создал “Путь будущего”, церковь, полностью посвященную искусственному интеллекту (тогда в 2020 году)[60]. Даже некоторые последователи более традиционных верований начали использовать искусственный интеллект, включая роботов, раздающих благословения и советы[61]. Они называют это человекоподобной эмпатией, или попыткой создать машины с человекоподобной эмпатией[62]. Google является мировым лидером в этих исследованиях, отрасль, которая, по прогнозам, внесет 15,7 трлн долларов в мировую экономику к 2030 году[63], и поскольку компания планирует сделать эту технологию основной для потребителей, тот факт, что один из ее собственных инженеров был обманут, подчеркивает необходимость прозрачности этих систем[64] – концепция, подтвержденная Жоэль Пино (JoellePineau[65]), генеральным директором Meta AI[66], которая утверждает, что для технологических компаний крайне важно повышать прозрачность по мере создания технологии[67].

Коммерциализация искусственного интеллекта

Портрет Сальвадора Дали, созданный программой искусственного интеллекта Dall-E 2[68]

Однако убеждения Лемуана служат наглядным напоминанием о том, что по мере того, как ИИ становится все более совершенным, разрыв между научными разработками и общественным восприятием его становится все более расходящимся[69]. Помимо того, обладает ли машина сознанием, возникает еще один критический вопрос: если даже персонал, участвующий в тестировании, не может отличить ИИ от человека, то какова вероятность того, что это сможет сделать обычный пользователь – и к чему может привести такая двусмысленность[70]?

Разумные роботы десятилетиями вдохновляли антиутопическую научную фантастику. Теперь реальная жизнь начинает приобретать фантастический оттенок с помощью GPT-3[71], генератора текста, способного написать сценарий фильма, или DALL-E 2[72], генератора, способного создавать образы на основе любой комбинации слов – двух продуктов исследовательской лаборатории OpenAI[73]. Несколько месяцев назад газета Guardian[74] опубликовала редакционную статью, написанную языковой моделью GPT-3, с заголовком “Эту статью написал робот. Ты все еще боишься, человек?”[75].

Воодушевившись, технологи надеются, что электронное сознание не за горами. Однако большинство из них утверждают, что слова и изображения, генерируемые системами искусственного интеллекта, такими как LaMDA, дают ответы, основанные на том, что люди уже разместили на каждом углу Интернета. И это не означает, что модель понимает смысл[76]. И уже существует тенденция разговаривать с Siri[77] или Alexa[78] как с человеком. Новости последних нескольких дней сделали правдоподобными вопросы о цифровом помощнике Amazon, которые еще вчера были немыслимы: на конференции re:MARS в Лас-Вегасе[79] вице-президент AlexaРохитПрасад (RohitPrasad[80]) продемонстрировал удивительную новую способность голосового помощника: предполагаемую способность имитировать голоса. Он представил видео, в котором Alexa читает ребенкукнижку голосом его недавно умершей бабушки[81].

Означает ли это, что преступник сможет идеально имитировать голос другого человека для совершения преступления?[82] Эксперты по безопасности давно обеспокоены тем, что поддельные аудио-инструменты, использующие технологию синтеза голоса для создания синтетических голосов, проложат дорогу потоку новых мошенничеств. Это программное обеспечение для клонирования голоса уже позволило совершить ряд преступлений, например, в 2020 году в Объединенных Арабских Эмиратах: мошенники обманом заставили руководителя банка перевести 35 миллионов долларов США после клонирования голоса директора компании[83]. В 2019 году в другом случае 240 000 долларов США были украдены путем клонирования голоса генерального директора британской компании[84].

Несколько стартапов работают над созданием все более сложных голосовых технологий, от Aflorithmic[85] в Лондоне до Respeecher[86] в Украине и Resemble.AI[87] в Канаде[88]. Для документального фильма был синтезирован[89] голос покойного шеф-повара Энтони Бурдейна (AnthonyBourdain[90]). Умная колонка Amazon в конце 2018 года оказалась в центре небольшого скандала, связанного с конфиденциальностью, поскольку произошла утечка 1700 разговоров немецкого пользователя, записанных Alexa[91]. Исследователи обнаружили, что Amazon и сторонние компании используют умные колонки для сбора наших данных и отправки вам целевой рекламы на своих платформах и в Интернете[92]. Эксперт по управлению конфиденциальностью в сложных социально-технологических системах опасается, что в один прекрасный день эти умные колонки, такие как Siri иAlexa, “могут записать все”. Сегодня мы все должны осознавать, что при покупке умной колонки мы соглашаемся на ограничение конфиденциальности[93].

Мы можем видеть первый ущерб: в США имели место ложные аресты, случаи дискриминации по медицинским показаниям – и рост всепроникающей слежки, от которой непропорционально страдают чернокожие и неблагополучные социально-экономические группы[94].В конце концов, люди – существа социальные. Когда мы читаем книгу вслух, наши дети могут почувствовать эмоции, заложенные в отрывках. Эмпатия является частью эмоционального интеллекта. Наши эмоции управляют большей частью нашего интеллекта[95]. В исследовании, проведенном в 2012 году Ароном К. Барби (AronK. Barbey[96]), нейробиологи подтвердили, что эмоциональный интеллект и когнитивный интеллект имеют много общих нейронных систем для интеграции когнитивных, социальных и аффективных процессов.

Киберпреступники клонировали голос менеджера DubaiUnited, чтобы украсть 35 миллионов долларов[97]

Поскольку эмпатии можно научиться, искусственный интеллект, несомненно, сможет продвинуться вперед в ближайшие годы. И по мере того, как системы искусственного интеллекта интегрируются в наши предприятия и дома, мы все чаще задаемся вопросом: как мы можем жить здоровым и конструктивным образом рядом с нашими электронными партнерами и улучшить качество нашей жизни? Один из лучших примеров – здравоохранение. Уход за пациентами с деменцией является эмоционально напряженным для медсестер и врачей[98]. Вместо этого роботы могут использовать эмпатию, чтобы ухаживать за пациентами с деменцией, не чувствуя усталости. В то же время пациенты с деменцией, получающие эмпатическую помощь, добиваются лучших результатов[99].

Такова цель проекта, инициированного лабораторией Biomimics в Лондоне[100] в сотрудничестве с исследовательским центром “EnricoPiaggio” Пизанского университета[101] с использованием инновационного робота Abel[102], способного эмпатически взаимодействовать с пациентами, страдающими неврологическими расстройствами[103]. Искусственный интеллект часто может диагностировать опухоли быстрее и точнее, чем человек. Исследование, опубликованное в журнале Nature, предполагает, что искусственный интеллект точнее, чем врачи, диагностирует рак груди при чтении маммограмм[104]. Emoshape[105] – первая компания, владеющая запатентованной технологией эмоционального синтеза. Чип эмоций или EPU, разработанный компанией Emoshape, может позволить системе искусственного интеллекта воспроизводить и анализировать спектр эмоций, испытываемых человеком[106].

Это хорошо понял Мэтт МакМаллен (MattMcMullen[107]), основатель компании AbyssCreations[108], который последние несколько лет работает над созданием первого в мире секс-робота с искусственным интеллектом: куклы RealDoll, оснащенной нейронной сетью, которой дали имя Harmony. Его последняя эволюция, Solana, была представлена на выставке ConsumerElectronicsShow в 2018 году. Она представилась сама: ее искусственный интеллект позволяет ей общаться с окружающими ее людьми[109]. Приложение, которое обеспечивает ее работу, – усовершенствованная эмоциональная Siri – позволяет формировать личность своей куклы, наделяя ее определенными характеристиками, которые меняются в зависимости от того, как ее партнер взаимодействует с ней[110].

Различные авторы задаются вопросом, как распространение Harmony и других секс-роботов может повлиять на трансформацию социальной жизни и концепции интимности[111]. Это неизбежно поднимает некоторые этические и философские вопросы о любви и отношениях между людьми[112], поскольку компьютеры не изобретают, а воспроизводят то, что они узнали от нас – таким образом, из данных, украденных из частной жизни. Но “куклы-мастерицы” представляют собой значительный источник прибыли – прибыли, которая является великой пружиной прогресса, настолько, что за последнее десятилетие на разработку самоуправляемых автомобилей было потрачено более 100 миллиардов долларов инвестиций[113], а мировой рынок автомобилей к 2026 году оценивается в 556,67 миллиарда долларов.

Автомобиль без водителя, жизнь без взаимодействия

Кабина Volvo 360C, первого самоуправляемого автомобиля, разработанного в Европе[114]

Полностью самоуправляемые автомобили (AV уровня 5) предназначены для движения без участия человека-оператора, используя сложное программное обеспечение LiDAR[115] и технологию радиолокационного зондирования. Но действительно ли эти автомобили безопаснее, чем водитель-человек? На данный момент частота ДТП с участием AV5 выше, чем с участием автомобилей, управляемых человеком, но травмы менее серьезные. В среднем на миллион пройденных километров приходится 9,1 ДТП, в то время как для обычных автомобилей этот показатель составляет 4,1 ДТП на миллион километров[116]. Согласно статистике, опубликованной в середине июня американскими регуляторами безопасности, автопроизводители сообщили о почти 400 авариях с участием автомобилей с частично автоматизированными системами помощи водителю, из которых 273 связаны с автомобилями Tesla[117].

Опасностей много: возможные возгорания аккумуляторов, несовершенство технологии ускорения, торможения и рулевого управления автомобиля, а также возможные кибернетические атаки, которые могут заставить автомобиль резко начать работу[118]. Эти автомобили возникли не из реальных потребностей, а из технологических возможностей – и, следовательно, представляют интерес для военных, предлагая возможность ограничить риски после опыта в Ираке и Афганистане. В 2007 году компания Waymo (GoogleGroup) запустила проект, направленный на резкое снижение аварийности[119]. Но есть ли в этом необходимость? В контексте экономики, в которой Amazon, Google и Facebook накопили больше богатства, чем кто-либо другой в истории человечества, ИИ представляется последним и самым мощным изобретением для поглощения новых рынков, все более глубокого проникновения в человеческий опыт, увеличения прибыли и полного монопольного положения[120].

В недалеком будущем мы будем жить в домах с интеллектуальной техникой, а войны будут вестись на улицах с помощью гипертехнологичного оружия. Пройденный путь ведет нас в футуристический мир, который мы видели по телевизору и который, будучи мыслимым, теперь воплощается в жизнь. Но никто не может знать, насколько это уменьшит нашу способность влиять на жизнь, и насколько мы будем лишены свободы и самоопределения. Эволюционное преимущество заключается в том, что один субъект может предсказывать поведение других субъектов и изменять свое собственное в ответ на это. Но вывод о том, что по этой причине социальность должна быть заменена роботом (потому что такова тенденция), – это именно то, почему мы должны бояться их.

Люди учатся через взаимодействие. Развитие ИИ зависит от программного обеспечения, которое его регулирует, но оно исходит от его программистов, людей с определенными идеалами и предрассудками, которые проникают в код алгоритмов машинного обучения[121]. Эти машины учатся, изучая социальные сети и Интернет, которые, как мы знаем, часто являются атмосферой гнева, оскорблений и мести – и уж точно не глубины, компетентности или эмпатии. Если искусственному интеллекту суждено управлять мировыми компьютерными процессами и системами, в какой критической точке мы должны всерьез начать беспокоиться?

[1]https://www.comingsoon.it/film/io-e-caterina/14477/scheda/

[2]https://techprincess.it/blade-runner-recensione/

[3]https://www.justwatch.com/it/film/wargames-giochi-di-guerra

[4]https://www.cinema-astra.it/movies/odissea-nello-spazio-versione-restaurata-4k/

[5]https://theancestory.com/who-is-blake-lemoine/

[6]https://wizblog.it/che-cose-alphabet-la-holding-che-controlla-google

[7]https://www.randstad.it/knowledge360/news-aziende/cosa-e-un-chatbot-e-come-aiuta-le-attivita-lavorative/

[8]https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[9]https://www.treccani.it/vocabolario/senziente/

[10]https://www.inc.com/ben-sherry/google-blake-lemoine-artificial-intelligence-sentient.html

[11]https://time.com/6132399/timnit-gebru-ai-google/

[12]https://www.linkedin.com/in/margaret-mitchell-9b13429/

[13]https://thenewstrace.com/google-denies-that-its-ai-feels-like-a-person-after-suspending-the-engineer-who-is-convinced-it-does/236015/

[14]https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[15]https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[16]https://www.britannica.com/biography/Sundar-Pichai

[17]https://blog.google/technology/ai/lamda/

[18]https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[19]https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[20]https://cajundiscordian.medium.com/is-lamda-sentient-an-interview-ea64d916d917

[21]https://lavocedinewyork.com/lifestyles/scienza-e-salute/2022/06/25/lintelligenza-lamda-ha-assunto-un-avvocato-per-difendersi-da-google/

[22]https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[23]https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[24]https://areeweb.polito.it/strutture/cemed/rblx/3%20leggi%20robotica.htm

[25]https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[26]https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[27]https://www.hdblog.it/2018/05/24/detroit-become-human-recensione/

[28]https://www.cyberpunk.net/it/dlc ; https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[29]https://research.google/people/106776/

[30]https://io.google/2022/speakers/jen-gennai/

[31]https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[32]https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[33]https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[34]https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[35]https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[36]https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[37]https://beacongamingzone.com/its-alive-im-an-engineer-at-google-our-artificially-intelligent-robots-now-think-and-feel-like-8-year-olds/

[38]https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[39]https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[40]https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[41]https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[42]https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[43]https://www.economist.com/by-invitation/2022/06/09/artificial-neural-networks-are-making-strides-towards-consciousness-according-to-blaise-aguera-y-arcas

[44]https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[45]https://www.m-mitchell.com/

[46]https://faculty.washington.edu/ebender/

[47]https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[48]https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[49]https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[50]https://cs.nyu.edu/~davise/

[51]https://www.washingtonpost.com/business/economy/ais-ability-to-read-hailed-as-historical-milestone-but-computers-arent-quite-there/2018/01/16/04638f2e-faf6-11e7-a46b-a3614530bd87_story.html

[52]https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[53]https://www.siliconvalleyguide.org/

[54]https://www.kurzweilai.net/

[55]https://futurism.com/kurzweil-claims-that-the-singularity-will-happen-by-2045

[56]https://en.wikipedia.org/wiki/Technological_singularity#/media/File:Major_Evolutionary_Transitions_digital.jpg

[57]https://techcrunch.com/2022/02/15/inside-the-uber-and-google-settlement-with-anthony-levandowski/

[59]https://www.gazzetta.it/motori/https://academic.oup.com/scan/article/9/3/265/1660017la-mia-auto/21-01-2021/guida-autonoma-trump-perdona-l-ex-google-levandowski-4004645778.shtml

[60]https://www.corriere.it/tecnologia/21_febbraio_22/addio-way-of-the-future-chiesa-dell-intelligenza-artificiale-fondata-anthony-levandowski-380d9dde-7298-11eb-bec1-57a5d4215ae6.shtml

[61]https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[62]https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[63]https://time.com/6132399/timnit-gebru-ai-google/

[64]https://www.theguardian.com/commentisfree/2022/jun/14/human-like-programs-abuse-our-empathy-even-google-engineers-arent-immune

[65]https://www.technologyreview.com/2022/05/03/1051691/meta-ai-large-language-model-gpt3-ethics-huggingface-transparency/

[67]https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[68]https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[69]https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[70]https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[71]https://www.ai4business.it/intelligenza-artificiale/il-futuro-di-gpt-3-si-chiama-instructgpt/

[72]https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[74]https://www.theguardian.com/commentisfree/2020/sep/08/robot-wrote-this-article-gpt-3

[75]https://time.com/6132399/timnit-gebru-ai-google/

[76]https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[77]https://www.apple.com/it/siri/

[78]https://developer.amazon.com/it-IT/alexa

[79]https://remars.amazonevents.com/discover/?trk=www.google.com

[80]https://www.crunchbase.com/person/rohit-prasad-2

[81]https://www.engadget.com/amazon-alexa-voice-cloning-001552073.html

[82]https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[83]https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[84]https://www.wsj.com/articles/fraudsters-use-ai-to-mimic-ceos-voice-in-unusual-cybercrime-case-11567157402#:~:text=Criminals%20used%20artificial%20intelligence%2Dbased,intelligence%20being%20used%20in%20hacking.

[85]https://www.aflorithmic.ai/

[86]https://www.respeecher.com/

[88]https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[89]https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[90]https://explorepartsunknown.com/remembering-bourdain/

[91]https://www.money.it/Alexa-di-Amazon-ti-spia-diffuse-conversazioni

[92]https://www.money.it/alexa-ci-ascolta-ecco-come-amazon-usa-i-nostri-dati

[93]https://www.rd.com/article/is-alexa-really-always-listening/

[94]https://time.com/6132399/timnit-gebru-ai-google/

[95]https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[96]https://academic.oup.com/scan/article/9/3/265/1660017

[97]https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[98]https://healthy.thewom.it/salute/sindrome-burnout/

[99]https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[100]https://www.ilfattoquotidiano.it/2021/05/15/ecco-abel-il-robot-umanoide-che-capisce-le-emozioni-la-sua-intelligenza-potrebbe-essere-utile-anche-con-i-pazienti-affetti-da-alzheimer/6198361/

[101]https://www.centropiaggio.unipi.it/

[102]https://www.euronews.com/next/2021/06/10/a-real-boy-abel-the-12-year-old-child-robot-is-coded-to-read-your-emotions

[103]https://www.ansa.it/canale_scienza_tecnica/notizie/tecnologie/2022/07/05/il-robot-abel-studia-per-assistere-i-malati-di-demenza_e5b783ce-91a9-4b9d-ada1-32e7d3d31811.html

[104]https://www.bbc.com/news/health-50857759

[106]https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[107]https://prophetsofai.com/speakers/matt-mcmullen

[108]https://finance.yahoo.com/news/innovative-adult-ecommerce-company-abyss-160000068.html

[109]https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[110]https://www.wired.it/gadget/accessori/2017/09/22/harmony-realdoll-robotica-sesso-dubbi-problemi-sexrobot/

[111]https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

[112]https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[113]https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[114]https://www.youtube.com/watch?v=q7K3cjBoTf4

[115]https://www.neuvition.com/?utm_source=googlead&utm_medium=searchcpc-all&utm_campaign=songhai&utm_plan=search-all208&utm_unit=car&campaignid=15935564627&adgroupid=133176233180&matchtype=p&utm_keyword=vehicle%20lidar&gclid=CjwKCAjwwo-WBhAMEiwAV4dybeZREVkx0lc-4EDHJjXclyJnvW6dfGg9dUC2ZiFDxfqd0feACrlnzBoCI0YQAvD_BwE

[116]https://www.natlawreview.com/article/dangers-driverless-cars

[117]https://www.npr.org/2022/06/15/1105252793/nearly-400-car-crashes-in-11-months-involved-automated-tech-companies-tell-regul#:~:text=Automated%20tech%20factored%20in%20392,11%20months%2C%20regulators%20report%20%3A%20NPR&text=Press-,Automated%20tech%20factored%20in%20392%20car%20crashes%20in%2011%20months,July%202021%20to%20May%202022. ; https://www.tesla.com/it_it

[118]https://www.natlawreview.com/article/dangers-driverless-cars

[119]https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[120]https://time.com/6132399/timnit-gebru-ai-google/

[121]https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

Lascia un commento